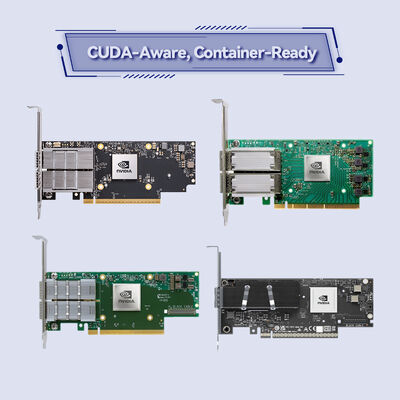

NVIDIA Mellanox ConnectX-6 MCX653106A-HDAT Dual-Port 200Gb/s InfiniBand Smart Adapter – PCIe 4.0 x16, In-Network Computing

Produktdetails:

| Markenname: | Mellanox |

| Modellnummer: | MCX653106A-HDAT-SP |

| Dokumentieren: | connectx-6-infiniband.pdf |

Zahlung und Versand AGB:

| Min Bestellmenge: | 1Stk |

|---|---|

| Preis: | Negotiate |

| Verpackung Informationen: | Äußere Box |

| Lieferzeit: | Auf der Grundlage der Bestände |

| Zahlungsbedingungen: | T/T |

| Versorgungsmaterial-Fähigkeit: | Versorgung nach Projekt/Batch |

|

Detailinformationen |

|||

| Produktstatus: | Aktie | Anwendung: | Server |

|---|---|---|---|

| Zustand: | Neu und Original | Typ: | Verdrahtet |

| Maximale Geschwindigkeit: | Bis zu 200 GB/s | Ethernet -Anschluss: | QSFP56 |

| Modell: | MCX653106A-HDAT | Name: | MCX653106A-HDAT-SP Mellanox intelligentes Hochgeschwindigkeitssafe Netzwerkkarte-200gbe |

| Hervorheben: | Mellanox ConnectX-6 Netzwerkadapter,200Gb/s InfiniBand Smart Adapter,PCIe 4.0 X16 Netzwerkkarte |

||

Produkt-Beschreibung

NVIDIA ConnectX-6 MCX653106A-HDAT 200Gb/s Dual-Port InfiniBand Smart Adapter

Branchenführende 200Gb/s InfiniBand- und Ethernet-Smart-Adapterkarte mit doppelten QSFP56-Ports, die eine Beschleunigung der Rechenleistung im Netzwerk, Verschlüsselung auf Blockebene und PCIe 4 bietet.0 x16 Host-Schnittstelle für HPC, KI und Cloud-Rechenzentren.

- InfiniBand (HDR) oder 200/100/50/40/25/10GbE-Konnektivität mit zwei Anschlüssen von 200 Gb/s

- PCIe Gen 4.0 x16 (auch kompatibel mit Gen 3.0) - bis zu 215 Millionen Nachrichten pro Sekunde

- Hardware-Auslastungen: NVMe-oF-Ziel/Initiator, XTS-AES 256/512-Bit-Verschlüsselung, MPI-Tag-Matching

- Unterstützung von NVIDIA In-Network Computing und GPUDirect RDMA

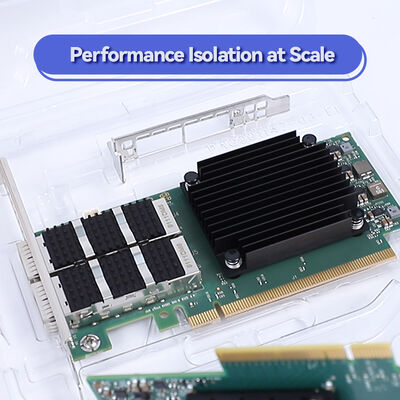

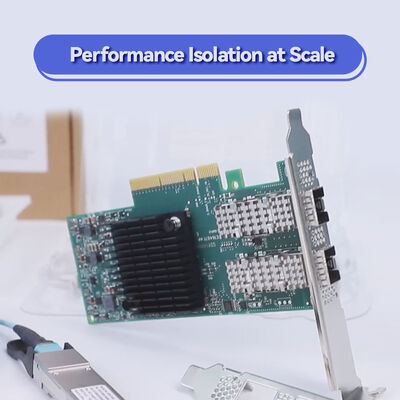

- PCIe-Stand-up-Formfaktor mit niedrigem Profil, RoHS-konform

Eigenschaften

- 200 Gb/s Durchsatz:Doppel-Ports, die mit bis zu 200 Gb/s InfiniBand (HDR) oder Ethernet mit voller bidirektionaler Bandbreite arbeiten.

- Netzwerkrechner:Entlastet kollektive Operationen (MPI, NCCL, SHMEM) mit NVIDIA SHARP-Technologie.

- Verschlüsselung auf Blockebene:Hardware AES-XTS 256/512-Bit-Verschlüsselung/Entschlüsselung ohne CPU-Überlastung; FIPS-konform.

- NVMe-oF-Auslastungen:Ziel- und Initiator-Ablastungen für NVMe über Fabrics, wodurch die CPU-Auslastung reduziert wird.

- Erweiterte Virtualisierung:SR-IOV bis zu 1K VF, ASAP2-Beschleunigung für OVS und virtuelles Schalten.

Technologie und Normen

Der MCX653106A-HDAT integriertNVIDIA In-Network ComputingMotoren (SHARP),RDMA (IBTA 1.3),RoCE, undNVMe-oFEs unterstütztPCIe Gen 4.0 (32 Fahrspuren als 2x16),PAM4 und NRZ SerDes, und erweiterte Funktionen wieDynamisch vernetzte Verkehrsmittel (DCT),Aufforderungspaging (ODP), undAnpassungsfähige Routing. Überlagerungs-Offloads für VXLAN, NVGRE, Geneve sind hardware-beschleunigt. Kompatibel mit IEEE 802.3bj, 802.3bm, 802.3by und InfiniBand Trade Association Spezifikationen.

Arbeitsprinzip: Intelligente Ablastarchitektur

ConnectX-6 überträgt Kommunikations- und Speicherfunktionen von der Host-CPU auf die Adapter-Hardware.zur Lagerung, NVMe-oF-Befehle werden direkt auf dem Adapter verarbeitet, wodurch CPU-Kerne freigesetzt werden.niedrigere Latenzzeit, höhere Nachrichtenrate (215 Mpps) und verbesserte Skalierbarkeit der Anwendung.

Anwendungen und Einsatz

- HPC-Cluster:MPI-basierte Simulationen mit geringer Latenz und hoher Nachrichtenrate.

- KI-Ausbildung:NVIDIA GPU-Cluster mit GPUDirect RDMA und NCCL-Kollektiven.

- NVMe-oF-Speicher:Ziel-/Initiator-Ablastung für Hochleistungs-NVMe-Speicherzugriff.

- Virtualisierte Rechenzentren:SR-IOV und ASAP2 für OVS-Auslastungen in NFV und Cloud.

- Multi-Socket-Server:Socket Direct-Konfigurationen zur Umgehung von QPI/UPI-Engpässen.

Technische Spezifikationen und Bestellmöglichkeiten

| Modell | Häfen und Geschwindigkeit | Host-Schnittstelle | Formfaktor | Verschlüsselung | Protokollen | OPN |

|---|---|---|---|---|---|---|

| ConnectX-6 | 2x QSFP56 (200Gb/s IB/Eth) | PCIe 4.0 x16 (Gen 3 kompatibel) | PCIe-Stand-up (niedriges Profil) | AES-XTS 256/512-Bit | InfiniBand, Ethernet, NVMe-oF | Die in Absatz 1 genannten Vorschriften gelten für die in Absatz 1 genannten Fahrzeuge. |

| ConnectX-6 | 1x QSFP56 (200 Gb/s) | PCIe 4.0 x16 | PCIe-Stand-up | AES-XTS | IB/Eth | Die in Absatz 1 genannten Anforderungen gelten nicht für die Berechnung der Leistungen. |

| ConnectX-6 | 2x QSFP56 (200 Gb/s) | PCIe 4.0 x16 | OCP 3.0 | AES-XTS | IB/Eth | Die in Absatz 1 genannten Anforderungen gelten nicht für die in Absatz 1 genannten Fahrzeuge. |

Hinweis: MCX653106A-HAT unterstützt 200Gb/s InfiniBand (HDR) und 200/100/50/25/10GbE. Abmessungen: 167,65mm x 68,90mm (ohne Halterung).Energieverbrauch < 15 Watt typisch.

Vorteile und Unterscheidungsmerkmale

- vs. Vorherige Generation (ConnectX-5):Verdoppelte Bandbreite (200Gb/s vs. 100Gb/s), integrierte SHARP für die In-Network-Computing und Verschlüsselung auf Blockebene.

- Gegenüber Wettbewerbern:Wirkliche Hardware-Auslastung für NVMe-oF- und MPI-Kollektive, nicht nur staatenlose Auslastungen.

- Socket-Direct-Option:Verfügbar für Multi-Socket-Server, um UPI/QPI-Engpässe zu beseitigen.

- FIPS-Konformität:Die Hardware-Verschlüsselung entspricht den Sicherheitsstandards der Regierung.

Service und Unterstützung

Wir bieten 24/7 technische Beratung, RMA-Dienstleistungen und Integrationsunterstützung für ConnectX-6-Adapter.Unser Team stellt Treibervalidierung für die wichtigsten Linux-Distributionen zur VerfügungFür InfiniBand-Fabrikdesign ist vorverkaufsfähige Konfigurationsunterstützung verfügbar.

Häufig gestellte Fragen (FAQ)

F: Ist der MCX653106A-HDAT mit 200Gb/s Quantumswitches kompatibel?

A:Ja, es ist vollständig interoperabel mit NVIDIA Quantum QM8700/QM8790-Switches und Quantum-2-Switches, wenn der HDR- oder NDR-Modus mit geeigneten Kabeln verwendet wird.

F: Kann dieser Adapter sowohl für Ethernet als auch für InfiniBand verwendet werden?

A:Ja, es unterstützt sowohl InfiniBand- als auch Ethernet-Protokolle.

F: Unterstützt es RoCE (RDMA über konvergiertes Ethernet)?

A:Ja, ConnectX-6 unterstützt RoCE vollständig und bietet RDMA mit geringer Latenz in Ethernet-Umgebungen.

F: Was ist die maximale Nachrichtenrate?

A:Der Adapter liefert bis zu 215 Millionen Nachrichten pro Sekunde, ideal für HPC-Arbeitslasten mit kleinen Paketen.

F: Ist die Karte mit PCIe Gen 3.0-Slots kompatibel?

A:Ja, es ist rückwärtskompatibel mit PCIe Gen 3.0 (x16), obwohl die Bandbreite aufgrund der Grenzen von Gen 3 auf ~ 100 Gb / s pro Port begrenzt ist.

Vorsichtsmaßnahmen und Hinweise auf die Vereinbarkeit

- PCIe-SchlittenanforderungFür volle 200Gb/s Leistung, installieren Sie in einem PCIe Gen 4.0 x16 Slot. Gen 3.0 Slots begrenzen den Durchsatz.

- Kühlung:Sicherstellung eines ausreichenden Luftstroms im Serverchassis; Passivkühlung erfordert mindestens 200 LFM.

- Kabel:Verwenden Sie QSFP56 passive/aktive Kupfer- oder optische Module für 200 Gb/s (HDR).

- Fahrerunterstützung:Verwenden Sie die neueste NVIDIA MLNX_OFED für Linux oder WinOF-2 für Windows.

- Betriebstemperatur:0°C bis 70°C; Lagerung zwischen -40°C und 85°C.

Einführung in das Unternehmen

Mit über einem Jahrzehnt Erfahrung betreiben wir eine große Fabrik, unterstützt von einem starken technischen Team.Unser umfangreicher Kundenstamm und unsere Fachkenntnisse im Bereich ermöglichen es uns, wettbewerbsfähige Preise anzubieten, ohne die Qualität zu beeinträchtigen.Als autorisierter Distributor für Mellanox, Ruckus, Aruba und Extreme haben wir Original-Netzwerk-Switches, Netzwerkkartenlösungen, drahtlose Access Points, Controller und Verkabelung.Wir halten ein Inventar von 10 Millionen USD aufrecht, um eine schnelle Erfüllung verschiedener Produktlinien zu gewährleistenJede Lieferung wird auf ihre Richtigkeit überprüft, und wir bieten 24/7 Beratung und technischen Support.Unsere professionellen Vertriebs- und technischen Teams haben sich auf den globalen Märkten einen hohen Ruf erworben..