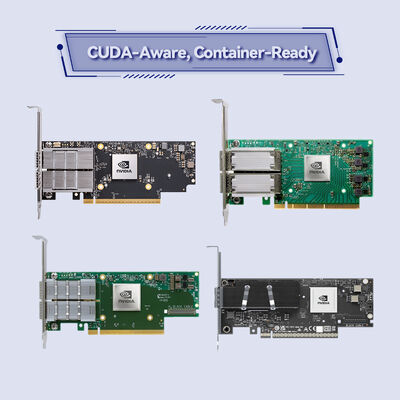

NVIDIA ConnectX-6 MCX653106A-HDAT 200 Gbit/s Dual-Port InfiniBand Smart Adapter

Produktdetails:

| Markenname: | Mellanox |

| Modellnummer: | MCX653106A-HDAT-SP |

| Dokumentieren: | connectx-6-infiniband.pdf |

Zahlung und Versand AGB:

| Min Bestellmenge: | 1Stk |

|---|---|

| Preis: | Negotiate |

| Verpackung Informationen: | Äußere Box |

| Lieferzeit: | Auf der Grundlage der Bestände |

| Zahlungsbedingungen: | T/T |

| Versorgungsmaterial-Fähigkeit: | Versorgung nach Projekt/Batch |

|

Detailinformationen |

|||

| Produktstatus: | Aktie | Anwendung: | Server |

|---|---|---|---|

| Zustand: | Neu und Original | Typ: | Verdrahtet |

| Maximale Geschwindigkeit: | Bis zu 200 GB/s | Ethernet -Anschluss: | QSFP56 |

| Modell: | MCX653106A-HDAT | Name: | MCX653106A-HDAT-SP Mellanox intelligentes Hochgeschwindigkeitssafe Netzwerkkarte-200gbe |

| Hervorheben: | NVIDIA ConnectX-6 Infiniband-Adapter,Mellanox 200 Gb/s Netzwerkkarte,Intelligenter InfiniBand-Adapter mit zwei Ports |

||

Produkt-Beschreibung

NVIDIA ConnectX-6 MCX653106A-HDAT

200 Gbit/s Dual-Port HDR InfiniBand Smart Adapter

Dieser PCIe 4.0 x16 Adapter liefert 215 Millionen Nachrichten/Sekunde und Hardware-basierte Beschleunigung für die anspruchsvollsten Rechenzentren.

Produktübersicht

Der NVIDIA ConnectX-6 MCX653106A-HDAT ist ein Dual-Port 200Gb/s InfiniBand- und Ethernet-Smart-Adapter, der als Eckpfeiler der NVIDIA Quantum InfiniBand-Plattform konzipiert wurde.Es integriert erweiterte Funktionen wie Remote Direct Memory Access (RDMA), NVMe über Fabrics (NVMe-oF) und Block-Level-Verschlüsselung, um den CPU-Overhead drastisch zu reduzieren.Dieser Adapter erhöht die Skalierbarkeit und Effizienz für Hochleistungsrechner, maschinelles Lernen und hyperscale Cloud-Infrastrukturen.

Wesentliche Merkmale

- Ultra-hohe Durchsatzleistung:200 Gb/s Konnektivität pro Port mit einer Gesamtbandbreite von maximal 200 Gb/s.

- Netzwerkrechner:Hardware-Ausladungen für kollektive Operationen, MPI-Tag-Matching und Rendezvous-Protokoll.

- Verschlüsselung auf Blockebene:XTS-AES 256/512-Bit-Hardwareverschlüsselung für FIPS-konforme Datensicherheit.

- Unterstützung von PCIe 4.0:16 GT/s Verbindungsrate mit voller Rückwärtskompatibilität mit PCIe 3.0/2.0/1.1.

- Nachrichtenrate:Bis zu 215 Millionen Nachrichten pro Sekunde für extreme kleine Paketleistung.

- Aufbewahrung:NVMe-oF-Ziel- und Initiatorentladungen, T10-DIF und Unterstützung für SRP, iSER, NFS RDMA.

- Virtualisierung:SR-IOV mit bis zu 1K virtuellen Funktionen und ASAP2 für OVS-Ablastung.

NVIDIA In-Network Computing Technologie

ConnectX-6 integriert die einzigartigen In-Network Computing-Engines von NVIDIA und überträgt kollektive Kommunikationsoperationen (wie MPI all-reduce) von der CPU auf das Netzwerkgewebe.Dies reduziert die Latenz drastisch und befreit CPU-Zyklen für die AnwendungsverarbeitungIn Kombination mit RDMA und Advanced Memory Mapping (UMR) ermöglicht der Adapter die GPU Direct RDMA und die Peer-to-Peer-GPU-Kommunikation über das Netzwerk hinweg.Beschleunigung von KI-Ausbildungsclustern und komplexen Simulationen.

Typische Einsätze

- Hochleistungsrechner (HPC):Große Cluster, die Wettersimulationen, fluidische Dynamik und molekulare Dynamik durchführen.

- KI und maschinelles Lernen:Verteilte Ausbildung von tiefen neuronalen Netzwerken, die hohen Durchsatz und geringe Latenz erfordern.

- Unternehmensdatenzentren:NVMe-oF-Speicherziele, Datenbankbeschleunigung und virtualisierte Infrastruktur.

- Hyper-Skala-Wolke:Multi-Tenant-Umgebungen, die eine Hardware-basierte Isolierung und Qualitätssicherung erfordern.

- Flüssiggekühlte Plattformen:Kompatibel mit Intel Server System D50TNP-Kaltplatten-Designs für hohe Dichte-Einsätze.

Vereinbarkeit

System und CPU:x86, Power, Arm, GPU (mit GPUDirect) und FPGA-basierte Plattformen.

Schalter:Vollständig interoperabel mit NVIDIA Quantum InfiniBand-Switches bis zu 200 Gb/s und Standard-Ethernet-Switches.

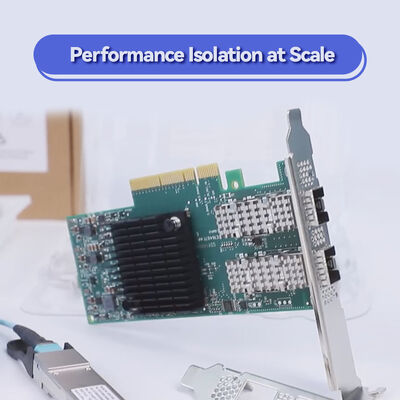

Kabel:Passive Kupfer-, aktive optische und DAC-Kabel mit QSFP56-Anschlüssen.

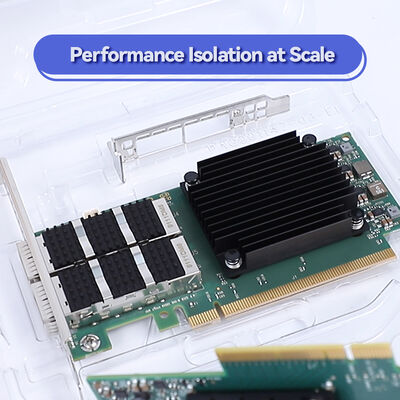

Technische Spezifikation

| Parameter | Einzelheiten |

|---|---|

| Produktbezeichnung | NVIDIA ConnectX-6 MCX653106A-HDAT |

| Unterstützte Geschwindigkeiten | InfiniBand: 200/100/50/40/25/10/1Gb/s; Ethernet: 200/100/50/40/25/10/1GbE |

| Netzwerkanschlüsse | 2x QSFP56 |

| Host-Schnittstelle | PCIe Gen 4.0/3.0 x16 (unterstützt auch x8, x4, x2, x1) |

| Nachrichtenrate | Bis zu 215 Millionen Nachrichten/Sekunde |

| InfiniBand-Eigenschaften | RDMA, XRC, DCT, ODP, Hardware-Überlastungskontrolle, 16M E/A-Kanäle, 8 VLs + VL15 |

| Ethernet-Auslastungen | RoCE, LSO/LRO, Kontrollsumme bei Entlastung, RSS/TSS, VXLAN/NVGRE/Geneve bei Entlastung |

| Speicherauslastungen | NVMe-oF (Ziel/Initiator), T10-DIF, SRP, iSER, SMB Direct |

| Sicherheit | Hardware XTS-AES 256/512-Bit-Blockverschlüsselung, FIPS-konform |

| Verwaltung | NC-SI, MCTP über SMBus/PCIe, PLDM für Monitor/Firmware, I2C, JTAG |

| Abmessungen | 167.65 mm x 68,90 mm (ohne Klammern) |

| Regulierung | RoHS- und ODCC-kompatibel |

Anmerkung: Die Spezifikationen basieren auf verfügbaren Unterlagen.

Auswahlführer: MCX653106A-HDAT

Dieses Modell ist die Dual-Port QSFP56-Variante im PCIe Stand-up-Formfaktor. Es unterstützt sowohl InfiniBand als auch Ethernet mit Geschwindigkeiten bis zu 200 Gb/s. Für Single-Port-Anforderungen betrachten wir den MCX653105A-HDAT.Für OCP 3.0 Formfaktor, siehe MCX653436A-HDAT-Serie.

| Häfen | Formfaktor | OPN | Anwendungsfall |

|---|---|---|---|

| 2x QSFP56 | PCIe Stand-up | Die in Absatz 1 genannten Vorschriften gelten für die in Absatz 1 genannten Fahrzeuge. | Dual-Port 200 Gb/s für Hochverfügbarkeitsknotenpunkte für HPC/KI |

| 1x QSFP56 | PCIe Stand-up | Die in Absatz 1 genannten Anforderungen gelten nicht für die Berechnung der Leistungen. | Ein-Anschluss 200 Gb/s für Standardrechnungen |

| 2x QSFP56 | Socket Direct | Die in Absatz 1 Buchstabe b genannten Angaben sind zu beachten. | Optimierung von Multi-Socket-Servern |

Vorteile des ConnectX-6 MCX653106A-HDAT

- Zukunftssichere E/A:PCIe 4.0 Bereitschaft gewährleistet Bandbreite für CPUs und GPUs der nächsten Generation.

- Sicherung nach Standard:Die an Bord installierte FIPS-konforme Verschlüsselung schließt die Notwendigkeit von selbstverschlüsselnden Laufwerken aus.

- Infrastrukturkonsolidierung:Ein Adapter unterstützt sowohl InfiniBand als auch Ethernet und vereinfacht die Inventur.

- Skalierbarer Speicher:Vollständige NVMe-oF-Ablastungen reduzieren die CPU-Last in dezaggregierten Speicherarchitekturen.

Service und Unterstützung

Unterstützt vom erfahrenen technischen Team der Hong Kong Starsurge Group, bieten wir:

- Unterstützung bei der Konfiguration vor dem Verkauf für Ihre spezifische HPC- oder Unternehmensumgebung.

- Weltweiter Versand mit Tracking und sicherer Verpackung.

- Firmware-Update-Anleitung und Unterstützung für den Download von Treibern.

- Garantie- und RMA-Dienstleistungen (Bedingungen können je nach Region variieren).

Häufig gestellte Fragen

F: Ist diese Karte mit Standard-Ethernet-Switches kompatibel?

A: Ja, der MCX653106A-HDAT unterstützt sowohl InfiniBand als auch Ethernet. Er kann bei 200/100/50/40/25/10/1GbE arbeiten.

F: Unterstützt es NVIDIA GPUDirect?

A: Absolut. Es unterstützt GPUDirect RDMA und PeerDirect für die direkte Kommunikation von GPU zu GPU über das Netzwerk.

F: Was ist der Unterschied zwischen MCX653106A-HDAT und MCX653106A-ECAT?

A: Das -HDAT-Suffix zeigt die Hochgeschwindigkeitsvariante an, die 200 Gb/s unterstützt, während -ECAT typischerweise eine niedrigere Geschwindigkeitsversion (100 Gb/s) anzeigt.

F: Kann ich diese Karte in einem PCIe Gen 3-Slot verwenden?

A: Ja, es ist rückwärtskompatibel mit PCIe Gen 3.0, aber die Bandbreite wird aufgrund des langsameren Busses auf ~ 100 Gbit/s pro Port begrenzt.

Vorsichtsmaßnahmen bei der Installation

- Sicherstellen eines ausreichenden Luftstroms; der Adapter kann in dichten Umgebungen aktiv gekühlt werden müssen.

- Verwenden Sie ausschließlich QSFP56-Module und Kabel, die für den Betrieb mit 200 Gb/s validiert sind, um Linkstabilität zu vermeiden.

- Überprüfen Sie, ob der PCIe-Slot-Biforkations-Support Ihres Motherboards mit der Socket Direct-Variante verfügbar ist.

- Bestätigen Sie das Strombudget: Die Karte bezieht Strom aus dem PCIe-Slot; Hochleistungsoptische Module benötigen möglicherweise zusätzliche Leistung.

Über die Hong Kong Starsurge Group Co., Limited

Die 2008 gegründete Hongkong Starsurge Group ist ein technologieorientierter Anbieter von Netzwerkhardware, IT-Dienstleistungen und Systemintegrationslösungen.Wir bedienen Kunden weltweit mit Produkten, einschließlich Netzwerk-SwitchesUnser erfahrenes Vertriebs- und Technikteam unterstützt Branchen wie Regierung, Gesundheitswesen, Fertigung, Bildung,FinanzenMit einem kundenorientierten Ansatz konzentriert sich Starsurge auf zuverlässige Qualität, reaktionsschnellen Service und maßgeschneiderte Lösungen, die Kunden helfen, effiziente, skalierbare,und eine zuverlässige NetzwerkinfrastrukturWir bieten IoT-Lösungen, Netzwerkmanagementsysteme, kundenspezifische Softwareentwicklung, mehrsprachigen Support und globale Lieferung an.

Die wichtigsten Fakten auf einen Blick

Kompatibilitätsmatrix

| Komponente | Unterstützt? | Anmerkungen |

|---|---|---|

| NVIDIA Quantenschalter | - Ja, das ist es. | Vollständige HDR-Interoperabilität von 200 Gb/s |

| PCIe-Mutterplatten der Generation 4.0 | - Ja, das ist es. | Vollständige 200Gb/s-Linienrate |

| PCIe-Mutterplatten der Generation 3.0 | - Ja, das ist es. | Beschränkt auf ~ 100 Gb/s pro Port |

| VMware vSphere | - Ja, das ist es. | Verfügbare Fahrer |

| Intel D50TNP mit Flüssigkeitskühlung | Besondere SKU | Es gibt eine Version der Kaltplatte; bestätigen Sie OPN |

Checkliste des Käufers

- Bestätigen Sie, dass der Server einen freien PCIe 4.0 x16-Slot (physischer und elektrischer) hat.

- Überprüfen Sie die InfiniBand-Stoffgeschwindigkeit: Diese Karte ist HDR-fähig (200 Gb/s).

- Wählen Sie für Ihre Entfernung geeignete QSFP56-Module (SR, LR oder DAC) aus.

- Stellen Sie sicher, dass Strom und Kühlung für den Hochgeschwindigkeitsbetrieb ausreichen.

- Überprüfen Sie OS/Treiberunterstützung: RHEL, Ubuntu, Windows Server usw.