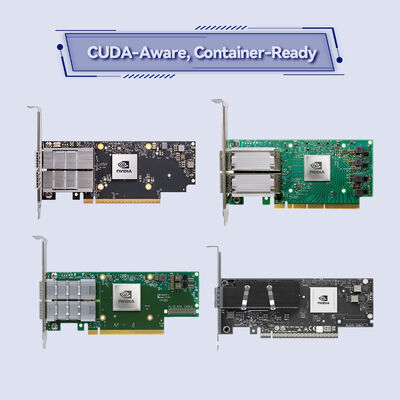

NVIDIA MCX555A-ECAT 100 Gbit/s Single-Port QSFP28 InfiniBand-Adapter PCIe 3.0 x16 ConnectX-5-Netzwerkkarte

Produktdetails:

| Markenname: | Mellanox |

| Modellnummer: | MCX555A-ECAT |

| Dokumentieren: | CONNECTX-5 infiniband.pdf |

Zahlung und Versand AGB:

| Min Bestellmenge: | 1Stk |

|---|---|

| Preis: | Negotiate |

| Verpackung Informationen: | Äußere Box |

| Lieferzeit: | Auf der Grundlage der Bestände |

| Zahlungsbedingungen: | T/T |

| Versorgungsmaterial-Fähigkeit: | Versorgung nach Projekt/Batch |

|

Detailinformationen |

|||

| Produktstatus: | Aktie | Anwendung: | Server |

|---|---|---|---|

| Zustand: | Neu und Original | Typ: | Verdrahtet |

| Maximale Geschwindigkeit: | EDR und 100GBE | Ethernet -Anschluss: | QSFP28 |

| Hervorheben: | NVIDIA ConnectX-5 InfiniBand-Adapter,100 Gbit/s QSFP28-Netzwerkkarte,PCIe 3.0 x16 Mellanox-Karte |

||

Produkt-Beschreibung

Hochleistungsfähige, latenzarme 100-Gbit/s-Netzwerkkarte für HPC-, KI- und Cloud-Rechenzentren. Mit fortschrittlichen Offloads, einschließlich NVMe over Fabrics, GPUDirect RDMA und Tag-Matching für MPI-Workloads – für branchenführenden Durchsatz und CPU-Effizienz.

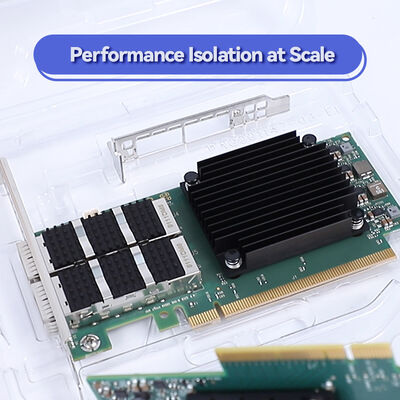

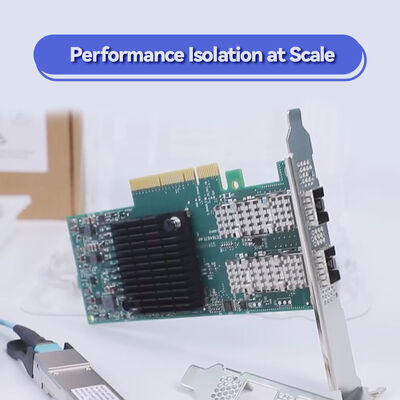

Die NVIDIA ConnectX-5 MCX555A-ECAT ist eine Single-Port 100-Gbit/s-InfiniBand-Adapterkarte im Low-Profile-PCIe-Formfaktor. Basierend auf der bewährten ConnectX-5-Architektur liefert sie bis zu 100 Gbit/s Durchsatz mit Latenzen unter einer Mikrosekunde und hoher Nachrichtenrate. Die Karte unterstützt sowohl InfiniBand (bis EDR) als auch 100GbE und bietet vielseitige Konnektivität für High-Performance-Computing, Speicher und virtualisierte Umgebungen.

Mit einem integrierten PCIe-Switch und fortschrittlichen RDMA-Funktionen entlastet die MCX555A-ECAT kritische Kommunikationsaufgaben von der CPU – für höhere Anwendungsleistung, geringeren Stromverbrauch und reduzierte Gesamtbetriebskosten. Sie ist vollständig kompatibel mit PCIe 3.0 x16-Steckplätzen und unterstützt eine breite Palette von Betriebssystemen und Beschleunigungs-Frameworks.

- Bis zu 100 Gbit/s Konnektivität pro Port (InfiniBand EDR / 100GbE)

- Einzelner QSFP28-Anschluss für optische oder Kupferkabel

- PCIe 3.0 x16 Host-Schnittstelle (automatische Aushandlung auf x8, x4, x2, x1)

- RDMA, Send/Receive-Semantik mit hardwarebasierter zuverlässiger Übertragung

- Tag-Matching und Rendezvous-Offloads für MPI und SHMEM

- NVMe over Fabrics (NVMe-oF) Target-Offloads für effizienten Speicher

- GPUDirect RDMA (PeerDirect) Beschleunigung für GPU-Kommunikation

- Hardwarebasierte Staukontrolle und adaptive Routing-Unterstützung

- SR-IOV-Virtualisierung: bis zu 512 virtuelle Funktionen

- RoHS-konformer Low-Profile-Formfaktor (hohes Bracket enthalten)

Die ConnectX-5-Architektur integriert eine Reihe von Hardware-Beschleunigungs-Engines, die die CPU-Intervention reduzieren und die Skalierbarkeit von Anwendungen verbessern:

- MPI Tag Matching & Rendezvous Offload: Offloads für Nachrichtenabgleich und Rendezvous-Protokollverarbeitung, was die MPI-Leistung für HPC-Cluster dramatisch verbessert.

- Out-of-Order RDMA mit adaptivem Routing: Ermöglicht die effiziente Nutzung mehrerer Netzwerkpfade bei gleichzeitiger Beibehaltung geordneter Abschlusssemantik, wodurch die Auslastung des Fabrics maximiert wird.

- NVMe-oF Target-Offloads: Ermöglicht NVMe-Speichersystemen, Fernzugriff mit nahezu null CPU-Overhead bereitzustellen, ideal für disaggregierte Speicherarchitekturen.

- Dynamically Connected Transport (DCT): Bietet extreme Skalierbarkeit für große Rechen- und Speichersysteme durch Eliminierung von Verbindungsaufbau-Overhead.

- ASAP2 Accelerated Switching & Packet Processing: Hardware-Offload für Open vSwitch (OVS) und Overlay-Netzwerk-Tunneling (VXLAN, NVGRE, GENEVE).

- On-Demand Paging (ODP): Unterstützt virtuelles Speicher-Paging für RDMA-Operationen, was die Anwendungsentwicklung vereinfacht.

- High-Performance Computing (HPC): Ideal für Supercomputing-Cluster, MPI-basierte Simulationen und wissenschaftliche Forschungs-Workloads, die niedrige Latenz und hohe Nachrichtenraten erfordern.

- KI- und Deep-Learning-Training: In Kombination mit GPUDirect RDMA ermöglicht es schnelle GPU-zu-GPU-Kommunikation über Knoten hinweg und beschleunigt Trainingszeiten.

- NVMe-oF-Speichersysteme: Einsatz als Speicherziele oder Initiatoren in NVMe over Fabrics-Umgebungen für hochdurchsatzstarken, latenzarmen Block-Speicherzugriff.

- Cloud- und virtualisierte Rechenzentren: SR-IOV und Virtualisierungs-Offloads unterstützen Multi-Tenant-Umgebungen mit garantierter QoS und sicherer Isolation.

- High-Frequency Trading (HFT): Extrem niedrige Latenz und Hardware-Zeitstempel (IEEE 1588v2) erfüllen die Anforderungen von Finanzdienstleistungsanwendungen.

Die MCX555A-ECAT ist für breite Kompatibilität mit NVIDIA InfiniBand-Switches (z. B. Quantum, Spectrum) und 100GbE-Switches von Drittanbietern ausgelegt. Sie unterstützt sowohl passive Kupfer-DACs als auch aktive optische Kabel über QSFP28-Ports.

Betriebssysteme & Software-Stacks:

- RHEL / CentOS, Ubuntu, Windows Server, FreeBSD, VMware ESXi

- OpenFabrics Enterprise Distribution (OFED) / WinOF-2

- NVIDIA HPC-X, OpenMPI, MVAPICH2, Intel MPI, Platform MPI

- Data Plane Development Kit (DPDK) für Kernel-Bypass

| Parameter | Spezifikation |

|---|---|

| Modell | MCX555A-ECAT |

| Formfaktor | PCIe Low-Profile (14,2 cm x 6,9 cm ohne Bracket), hohes Bracket vorinstalliert, kurzes Bracket enthalten |

| Portgeschwindigkeit & Typ | 1x QSFP28, bis zu 100 Gbit/s InfiniBand (EDR) und 100GbE |

| Host-Schnittstelle | PCI Express 3.0 x16 (kompatibel mit x8, x4, x2, x1) |

| InfiniBand-Unterstützung | IBTA 1.3-konform, 100 Gbit/s EDR, FDR, QDR, DDR, SDR; 8 virtuelle Lanes + VL15; 16 Millionen I/O-Kanäle |

| Ethernet-Unterstützung | 100GbE, 50GbE, 40GbE, 25GbE, 10GbE, 1GbE; IEEE 802.3cd, 802.3bj, 802.3by, 802.3ba, 802.3ae |

| RDMA-Fähigkeiten | RDMA over Converged Ethernet (RoCE), hardwarebasierte zuverlässige Übertragung, Out-of-Order RDMA, atomare Operationen |

| Storage-Offloads | NVMe over Fabrics Target-Offload, iSER, SRP, NFS RDMA, SMB Direct, T10 DIF-Signaturübergabe |

| Virtualisierung | SR-IOV (bis zu 512 virtuelle Funktionen), VMware NetQueue, NPAR, PCIe Access Control Services (ACS) |

| CPU-Offloads | TCP/UDP/IP zustandslose Offloads, LSO/LRO, Checksum-Offload, RSS/TSS, VLAN/MPLS-Tag-Einfügung/Entfernung |

| Overlay-Netzwerke | Hardware-Offload für VXLAN, NVGRE, GENEVE Kapselung/Entkapselung |

| Management | NC-SI über MCTP, PLDM für Überwachung/Steuerung und Firmware-Update, I2C, SPI, JTAG |

| Remote Boot | Remote Boot über InfiniBand, Ethernet, iSCSI; UEFI, PXE-Unterstützung |

| Stromverbrauch | Nicht öffentlich spezifiziert; typischer Bereich unter 20 W – bitte für Ihr System bestätigen |

| Betriebstemperatur | 0 °C bis 55 °C (typische Umgebung) |

| Konformität | RoHS, REACH, FCC, CE, VCCI, ICES, RCM |

Hinweis: Spezifikationen stammen aus der NVIDIA ConnectX-5 Produktdokumentation. Die neuesten Details und Firmware-Unterstützung finden Sie in den offiziellen NVIDIA Release Notes.

| Bestellnummer | Ports / Geschwindigkeit | Host-Schnittstelle | Formfaktor | Hauptmerkmale |

|---|---|---|---|---|

| MCX555A-ECAT | 1x QSFP28, 100 Gbit/s | PCIe 3.0 x16 | Low-Profile PCIe | Standard Single-Port, EDR InfiniBand / 100GbE |

| MCX556A-ECAT | 2x QSFP28, 100 Gbit/s | PCIe 3.0 x16 | Low-Profile PCIe | Dual-Port, EDR/100GbE |

| MCX556A-EDAT | 2x QSFP28, 100 Gbit/s | PCIe 4.0 x16 | Low-Profile PCIe | ConnectX-5 Ex, verbesserte PCIe Gen4 |

| MCX556M-ECAT-S25 | 2x QSFP28, 100 Gbit/s | 2x PCIe 3.0 x8 | Socket Direct | Dual-Socket-Serververbindung über Kabelbaum |

| MCX545B-ECAN | 1x QSFP28, 100 Gbit/s | PCIe 3.0 x16 | OCP 2.0 Typ 1 | Open Compute Project Formfaktor |

Für OCP- oder Multi-Host-Varianten kontaktieren Sie bitte den Vertrieb. Alle Karten unterstützen Abwärtskompatibilität zu niedrigeren Geschwindigkeiten.

- Überragende Anwendungsleistung: Hardware-Offloads für MPI, NVMe-oF und Overlays geben CPU-Kerne für Geschäftslogik frei.

- Skalierbares RDMA-Fabric: DCT, XRC und Out-of-Order RDMA bieten lineare Skalierbarkeit für Tausende von Knoten.

- Bereit für GPU-Beschleunigung: GPUDirect RDMA ermöglicht direkten Speicherzugriff zwischen GPUs und Netzwerkkarten und eliminiert CPU-Engpässe in KI-Clustern.

- Flexible Bereitstellung: Der einzelne QSFP28-Port vereinfacht die Verkabelung und ist ideal für 100-Gbit/s-Leaf-Spine-Architekturen.

- Investitionsschutz: Die Unterstützung von InfiniBand und Ethernet ermöglicht einen nahtlosen Übergang zwischen Protokollen, wenn sich die Anforderungen ändern.

Hong Kong Starsurge Group bietet umfassenden Lifecycle-Support für NVIDIA ConnectX-5-Adapter, einschließlich Pre-Sales-Konfigurationsunterstützung, Anleitung zur Firmware-Aktualisierung und Garantieservice. Unser technisches Team kann Ihnen helfen bei:

- Kompatibilitätsprüfung mit Ihrer Server- und Switch-Infrastruktur

- Leistungsoptimierung für HPC- oder Speicher-Workloads

- Benutzerdefinierte Bracket-Optionen und Anforderungen an Bulk-Verpackungen

- RMA-Abwicklung und Advanced Replacement Services

Kontaktieren Sie unsere Vertriebsingenieure für Volumenpreise und Lieferzeiten.

Elektrostatische Entladung (ESD): Verwenden Sie immer ESD-sichere Praktiken bei der Handhabung des Adapters. Lagern Sie ihn bis zur Installation in antistatischer Verpackung. Kühlungsanforderungen: Sorgen Sie für ausreichenden Luftstrom im Servergehäuse, um die Betriebstemperatur im angegebenen Bereich zu halten. Firmware-Updates: Verwenden Sie offizielle NVIDIA Firmware-Tools (MFT) und überprüfen Sie die Kompatibilität mit Ihrem Betriebssystem und Ihrer Treiberversion vor dem Update. Kabelbiegung: Befolgen Sie die Richtlinien für den Biegeradius von QSFP28-Kabeln, um Signalverschlechterungen zu vermeiden.

Dies ist ein Produkt der Klasse A. In einer Wohnumgebung kann es Funkstörungen verursachen. Stellen Sie eine ordnungsgemäße Abschirmung und Erdung gemäß den örtlichen Vorschriften sicher.

Gegründet im Jahr 2008, Hong Kong Starsurge Group Co., Limited ist ein technologieorientierter Anbieter von Netzwerkhardware, IT-Dienstleistungen und Systemintegrationslösungen. Starsurge bedient Kunden weltweit mit Produkten wie Netzwerk-Switches, NICs, drahtlosen Zugangspunkten, Controllern und Hochgeschwindigkeitskabeln und kombiniert tiefes technisches Fachwissen mit einem kundenorientierten Ansatz. Das Unternehmen unterstützt Branchen wie Regierung, Gesundheitswesen, Fertigung, Bildung, Finanzen und Unternehmen und bietet IoT-Lösungen, Netzwerkmanagement-Systeme, kundenspezifische Softwareentwicklung und mehrsprachige globale Lieferung. Mit Fokus auf zuverlässige Qualität und reaktionsschnellen Service hilft Starsurge Kunden beim Aufbau effizienter, skalierbarer und zuverlässiger Netzwerkinfrastrukturen.

| Komponente / System | Kompatibilitätsstatus | Hinweise |

|---|---|---|

| NVIDIA Quantum InfiniBand Switches | Zertifiziert | EDR, HDR-Kompatibilität bei Verwendung geeigneter Firmware |

| NVIDIA Spectrum Ethernet Switches | Zertifiziert | Unterstützte Modi: 100GbE, 50GbE, 25GbE |

| 100GbE-Switches von Drittanbietern | Kompatibel | Erfordert Konformität mit IEEE-Standards; getestet mit wichtigen Anbietern |

| GPU-Server (NVIDIA DGX, HGX) | Zertifiziert mit GPUDirect | RDMA-Beschleunigung für Multi-GPU-Kommunikation |

| Speicherarrays mit NVMe-oF | Unterstützt | Target-Offload ermöglicht effizienten NVMe-Fabric-Zugriff |

- ☑ Bestätigen Sie, dass der Server über einen freien PCIe 3.0 x16 (oder x8) Steckplatz mit ausreichend Platz verfügt.

- ☑ Bestimmen Sie die Portanzahl: Single-Port (MCX555A-ECAT) vs. Dual-Port (MCX556A-ECAT).

- ☑ Wählen Sie den Kabeltyp: passive Kupfer-DACs für kurze Distanzen (≤5m) oder optische Kabel für längere Strecken.

- ☑ Überprüfen Sie die Unterstützung für Betriebssystem und Treiber (OFED, Windows, VMware).

- ☑ Stellen Sie für GPU-Cluster die GPUDirect RDMA-Kompatibilität mit Ihrem GPU-Modell und Ihrer Treiberversion sicher.

- ☑ Prüfen Sie, ob für Ihr Servergehäuse ein hohes oder kurzes Bracket erforderlich ist.

- NVIDIA MCX556A-ECAT – Dual-Port 100 Gbit/s ConnectX-5 Adapter

- NVIDIA MCX556A-EDAT – ConnectX-5 Ex mit PCIe 4.0 Unterstützung

- NVIDIA Quantum-2 QM9700 40-Port 800 Gbit/s InfiniBand Switch

- Mellanox QSFP28 passive DAC-Kabel (1m, 2m, 3m)

- NVIDIA Spectrum-4 SN5600 100GbE/400GbE Ethernet Switches

- Benutzerhandbuch für NVIDIA ConnectX-5 InfiniBand-Adapterkarten

- Anleitung zur Bereitstellung von RDMA over Converged Ethernet (RoCE)

- Best Practices für GPUDirect RDMA in KI-Clustern

- NVMe over Fabrics mit ConnectX-5 – Konfigurationshandbuch

- OFED Installations- und Tuning-Handbuch