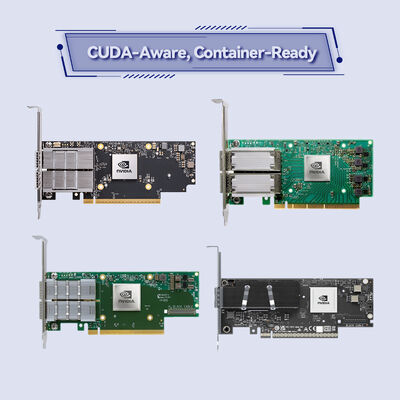

NVIDIA ConnectX-6 InfiniBand Adapter MCX653106A-ECAT 200 Gbit/s Smart NIC

Produktdetails:

| Markenname: | Mellanox |

| Modellnummer: | MCX653106A-ECAT |

| Dokumentieren: | connectx-6-infiniband.pdf |

Zahlung und Versand AGB:

| Min Bestellmenge: | 1Stk |

|---|---|

| Preis: | Negotiate |

| Verpackung Informationen: | Äußere Box |

| Lieferzeit: | Auf der Grundlage der Bestände |

| Zahlungsbedingungen: | T/T |

| Versorgungsmaterial-Fähigkeit: | Versorgung nach Projekt/Batch |

|

Detailinformationen |

|||

| Produktstatus: | Aktie | Anwendung: | Server |

|---|---|---|---|

| Schnittstellentyp:: | Infiniband | Häfen: | Dual |

| Maximale Geschwindigkeit: | 100gbe | Typ: | Verdrahtet |

| Zustand: | Neu und Original | Garantiezeit: | 1 Jahr |

| Modell: | MCX653106A-ECAT | Name: | Mellanox-Netzwerkkarte Original MCX653106A-ECAT verbinden X-6 100Gb/s Dual-Port QSFP56 Ethernet-Adap |

| Stichwort: | Mellanox Network Card | ||

| Hervorheben: | NVIDIA ConnectX-6 Infiniband-Adapter,200 Gbit/s Smart NIC,Mellanox-Netzwerkkarte mit Garantie |

||

Produkt-Beschreibung

200 Gb/s Dual-Port Smart Adapter mit Netzwerkrechner

Die NVIDIA ConnectX-6 MCX653106A-ECAT liefert bis zu200 Gbit/sBandbreite, Sub-Mikrosekunden-Latenz und Hardware-Auslastungen für HPC, KI und hyperkonvergierte Speicherung.0, maximiert der Dual-Port QSFP56 InfiniBand-Adapter die Effizienz und Skalierbarkeit des Rechenzentrums.

DieDie in Absatz 1 genannten Anforderungen gelten nicht für die in Absatz 1 genannten Fahrzeuge.ist Teil der NVIDIA ConnectX-6 InfiniBand-Adapterfamilie, die für die anspruchsvollsten Arbeitslasten entwickelt wurde. Es kombiniert zwei QSFP56-Ports mit einer InfiniBand- oder Ethernet-Konnektivität von 200 Gb/s,Bereitstellung von hardwarebasiertem zuverlässigen TransportDurch die Abfertigung kollektiver Operationen, MPI-Tag-Matching und Verschlüsselung von der Host-CPU,Der Adapter reduziert den CPU-Overhead und erhöht die Anwendungsleistung in großflächigen ClusternUnternehmen, Forschungslabors und Hyper-Scale-Rechenzentren verlassen sich auf ConnectX-6 um energieeffiziente, langfristige Stoffe zu bauen.

Bis zu 200 Gb/s pro Port (HDR InfiniBand / 200 GbE)

Bis zu 215 Millionen Nachrichten/Sekunde

XTS-AES 256/512-Bit auf Blockebene, FIPS-konform

Gemeinsame Entlastungen, NVMe-oF-Ziel-/Initiatorentlastungen

PCIe Gen 4.0/3.0 x16 (Hilfe für zwei Ports)

SR-IOV bis zu 1K VF, ASAP2, Open vSwitch offload

Unterstützung von RoCE, XRC, DCT, On-Demand Paging, Adaptive Routing

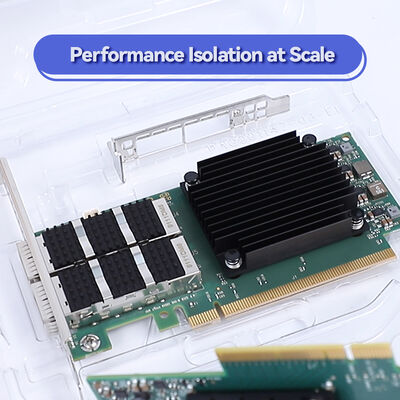

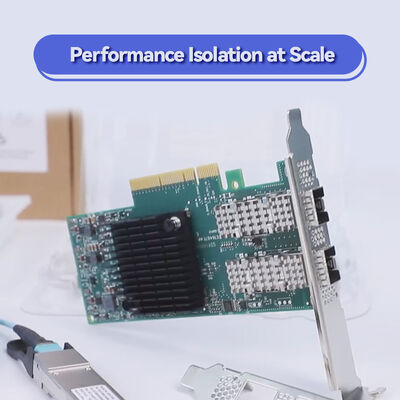

Stand-up-PCIe (niedriges Profil), QSFP56 mit zwei Ports

ConnectX-6 basiert auf der bewährten InfiniBand-Architektur von NVIDIAIn-Network-ComputingDer Adapter unterstützt die Entwicklung von MPI-Anwendungen, Deep-Learning-Frameworks und Speicherprotokollen.Ferner direkter Speicherzugriff (RDMA)Die Hardware-basierte Überlastungskontrolle gewährleistet eine vorhersehbare Leistung auch unter starker Last.NVIDIA GPUDirect RDMAermöglicht den direkten Datenaustausch zwischen GPU-Speicher und dem Netzwerkadapter, wodurch die Latenzzeit für die KI-Ausbildung verringert wird.NVMe über Stoffe (NVMe-oF)Die Karte reduziert die CPU-Auslastung in Speicher-Arrays und ermöglicht gleichzeitig einen hohen Durchsatz und einen niedrigen Latenzzugang zu NVMe-Flash.

- Hochleistungsrechner (HPC):Größere Simulationen, Wettermodelle und fluidische Computerdynamik, die eine geringe Latenzzeit und eine hohe Bandbreite erfordern.

- Kluster für KI und maschinelles LernenVerteiltes Training von tiefen neuronalen Netzwerken, mit GPUDirect und RDMA für maximale Effizienz.

- NVMe-oF-Speichersysteme:Ziel- oder Initiator-Auslastungen ermöglichen einen leistungsstarken dezaggregierten Speicher mit geringem CPU-Overhead.

- Datenzentren auf Hyperskala:Virtualisierte Umgebungen mit SR-IOV, Überlagerungsnetzwerken und Service-Chaining.

- Finanzdienstleistungen:Ultra-Low-Latency-Handelsinfrastruktur, die eine deterministische Leistung erfordert.

Der ConnectX-6 MCX653106A-ECAT ist mit einer Vielzahl von Servern, Switches und Betriebssystemen kompatibel.mit einer Leistung von mehr als 50 W und einer Leistung von mehr als 50 WDer Adapter unterstützt Standard-PCIe-Slots (x16, x8, x4) und enthält Treiberunterstützung für die wichtigsten Betriebssystemplattformen.

| Parameter | Spezifikation |

|---|---|

| Produktmodell | Die in Absatz 1 genannten Anforderungen gelten nicht für die in Absatz 1 genannten Fahrzeuge. |

| Datenrate | 200 Gbps, 100 Gbps, 50 Gbps, 40 Gbps, 25 Gbps, 10 Gbps, 1 Gbps (InfiniBand und Ethernet) |

| Häfen | 2x QSFP56-Anschlüsse |

| Host-Schnittstelle | PCIe Gen 4.0 / 3.0 x16 (unterstützt x8, x4, x2, x1 Konfigurationen) |

| Verzögerung | Extrem geringe Submikrosekunden (typisch < 0,8 μs) |

| Nachrichtenrate | Bis zu 215 Millionen Nachrichten/Sekunde |

| Verschlüsselung | XTS-AES 256/512-Bit, FIPS 140-2-Konformität bereit |

| Formfaktor | PCIe-Low-Profile-Stand-up (mit hoher Halterung montiert, kurze Halterung eingeschlossen) |

| Abmessungen (ohne Klammer) | 167.65mm x 68.90mm |

| Stromverbrauch | Typische 22 W (je nach Verkehr) |

| Virtualisierung | SR-IOV (1K VFs), VMware NetQueue, NPAR, ASAP2 Flussentladung |

| Verwaltung | NC-SI, MCTP über PCIe/SMBus, PLDM für Firmware-Aktualisierung und Überwachung |

| Fernsteuerung | InfiniBand, iSCSI, PXE, UEFI |

| Betriebssysteme | RHEL, SLES, Ubuntu, Windows Server, FreeBSD, VMware vSphere, OFED-Stack |

| Nummer des Bestellteils (OPN) | Häfen | Höchstgeschwindigkeit | Host-Schnittstelle | Hauptunterscheidungsmerkmal |

|---|---|---|---|---|

| Die in Absatz 1 genannten Anforderungen gelten nicht für die in Absatz 1 genannten Fahrzeuge. | 2x QSFP56 | 100 Gbit/s (auch niedriger) | PCIe 3.0/4.0 x16 | Dual-Port 100GbE/IB, erweiterte Offloads, Krypto optional? Keine eingebaute Krypto in dieser Variante, unterstützt aber Blockverschlüsselung über Software? Eigentlich Hardware-AES-Engine, konsultiere Spezifikationen;Ideal für Virtualisierung und Speicherung |

| Die in Absatz 1 genannten Anforderungen gelten nicht für die Berechnung der Leistungen. | 1x QSFP56 | 200 Gbit/s | PCIe 3.0/4.0 x16 | Single-Port 200 Gb/s, Kryptounterstützung |

| Die in Absatz 1 genannten Vorschriften gelten für die in Absatz 1 genannten Fahrzeuge. | 2x QSFP56 | 200 Gbit/s | PCIe 3.0/4.0 x16 | Dual-Port 200Gb/s volle Bandbreite, Krypto-Ablastung |

| Die in Absatz 1 genannten Anforderungen gelten nicht für die in Absatz 1 genannten Fahrzeuge. | 1x QSFP56 | 100 Gbit/s | PCIe x16 | Ein-Port 100Gb/s, kostengünstiger |

| MCX653436A-HDAT (OCP 3.0) | 2x QSFP56 | 200 Gbit/s | PCIe 3.0/4.0 x16 | OCP 3.0 kleiner Formfaktor, mit zwei Anschlüsse |

- Maximierte Anwendungsleistung:Hardware-Ablastungen für MPI, NVMe-oF und Verschlüsselung befreien CPU-Kerne für tatsächliche Arbeitslasten.

- Zukunftsfähige Bandbreite:PCIe 4.0 und 200Gb/s Bereitschaft sorgen für eine langlebige Lebensdauer in Hochgeschwindigkeitsgeweben.

- Netzwerkspeicher und Computing:Unterstützt kollektive Entladungen und Burst-Puffer, wodurch die Datenbewegung reduziert wird.

- Vertrauenswürdige Sicherheit:Die AES-XTS-Verschlüsselung auf Blockebene mit FIPS-Konformität gewährleistet den Schutz von Daten im Ruhezustand und während des Transits ohne Leistungsschlag.

- Vereinfachte Verwaltung:Breite OS- und Hypervisorunterstützung mit einem einheitlichen Treiberstack (OFED, WinOF-2).

Hong Kong Starsurge Group bietet vollständigen technischen Support, Garantie-Abdeckung und RMA-Dienstleistungen für alle NVIDIA ConnectX Adapter.Firmware-UpdatesWir bieten weltweiten Versand, Massenpreise für Rechenzentrumsprojekte und individuelle Bestandsreservierungen.Kontaktieren Sie unser Verkaufsteam, um maßgeschneiderte Angebote und Details zur Lieferzeit zu erhalten..

• Stellen Sie sicher, dass der PCIe-Slot ausreichend Strom liefert (bis zu 75 W über den Slot; dieser Adapter verwendet in der Regel < 25 W).

• Für flüssiggekühlte Plattformen prüfen Sie die Kompatibilität mit Intel Server System D50TNP, wenn eine Kaltplattenvariante erforderlich ist (dieser OPN ist standardmäßig luftgekühlt).

• Überprüfen Sie die Kompatibilität der Betriebssystemtreiber mit den neuesten OFED- oder WinOF-2-Stacks.

Seit 2008 liefert die Hong Kong Starsurge Group Co., Limited weltweit Netzwerkhardware, Systemintegration und IT-Dienstleistungen auf Unternehmensebene.Starsurge bietet zertifizierte Lösungen für die RegierungDas technische Team sorgt für eine reibungslose Implementierung, von der Vorverkaufs-Architektur bis hin zum Nachverkaufs-Support.,Wir bieten maßgeschneiderte, skalierbare Infrastrukturkomponenten, einschließlich NICs, Switches, Kabeln und End-to-End-Netzwerklösungen.

Weltweite Lieferung · Mehrsprachiger Support · OEM-Dienstleistungen verfügbar

| Komponente / Ökosystem | Unterstützt | Anmerkungen |

|---|---|---|

| NVIDIA Quantum HDR-Schalter | ✓ Ja | 200 Gb/s vollständige Gewebeintegration |

| Ethernet 200G/100G-Switches | ✓ Ja | Erfordert kompatible Transceiver/FEC-Modi |

| GPU Direct RDMA | ✓ Ja | NVIDIA-GPU-Serie unterstützt |

| VMware vSphere / ESXi | ✓ Zertifiziert | Einheimische Fahrer, Unterstützung von SR-IOV |

| Windows Server 2019/2022 | ✓ Ja | WinOF-2-Treiberpaket |

| Linux Kernel und OFED | ✓ volle Unterstützung | MLNX_OFED, Inbox-Treiber |

- Bestätigen Sie die erforderliche Verbindungsgeschwindigkeit: 100Gb/s Dual-Port erfüllt Ihren Cluster-Bandbreitenplan? Für 200Gb/s Dual-Port, betrachten -HDAT OPN.

- Überprüfen Sie den Server PCIe-Slot: x16 physikalisch, Gen 3 oder Gen 4 empfohlen.

- Kontrollkabeltyp: QSFP56 passives Kupfer (bis zu 5 m) oder aktive optische Kabel für längere Reichweite.

- Sicherstellen, dass Betriebssystemtreiber verfügbar sind (OFED, WinOF).

- Für Verschlüsselungsanforderungen: Bestätigen Sie, ob eine eingebaute Blockverschlüsselung erforderlich ist. MCX653106A-ECAT unterstützt AES-XTS, bestätigen Sie jedoch immer die FIPS-Ebene mit dem NVIDIA-Datenblatt.

- Bewertung der Virtualisierungsbedürfnisse: SR-IOV, VXLAN-Offload usw.