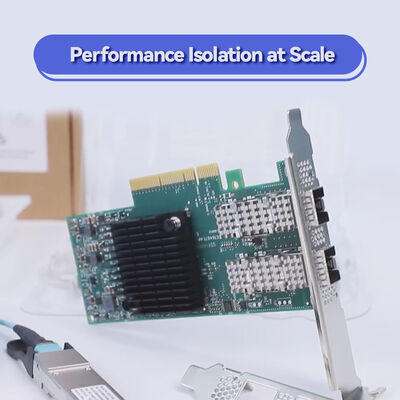

NVIDIA ConnectX-6 MCX653105A-HDAT 200 Gbit/s Single-Port InfiniBand Smart Adapter mit Hardware-Verschlüsselung & PCIe 4.0

Produktdetails:

| Markenname: | Mellanox |

| Modellnummer: | MCX653105A-HDAT |

| Dokumentieren: | connectx-6-infiniband.pdf |

Zahlung und Versand AGB:

| Min Bestellmenge: | 1Stk |

|---|---|

| Preis: | Negotiate |

| Verpackung Informationen: | Äußere Box |

| Lieferzeit: | Auf der Grundlage der Bestände |

| Zahlungsbedingungen: | T/T |

| Versorgungsmaterial-Fähigkeit: | Versorgung nach Projekt/Batch |

|

Detailinformationen |

|||

| Produktstatus: | Aktie | Anwendung: | Server |

|---|---|---|---|

| Zustand: | Neu und Original | Typ: | Verdrahtet |

| Maximale Geschwindigkeit: | Bis zu 200 GB/s | Ethernet -Anschluss: | QSFP56 |

| Modell: | MCX653105A-HDAT | ||

| Hervorheben: | NVIDIA ConnectX-6 Infiniband-Adapter,200 Gbit/s PCIe 4.0-Netzwerkkarte,InfiniBand-Adapter mit Hardware-Verschlüsselung |

||

Produkt-Beschreibung

200Gb/s Single-Port HDR Smart Adapter mit Netzwerkrechner und Hardwareverschlüsselung

Die NVIDIA ConnectX-6Die in Absatz 1 genannten Anforderungen gelten nicht für die Berechnung der Leistungen.bietet einen vollen Durchsatz von 200 Gb/s auf einem einzigen QSFP56-Port, kombiniert ultra-niedrige Latenz, Hardware-Offloads und Block-Level-XTS-AES-Verschlüsselung.dieser PCIe 4.0 x16 Adapter entladen kollektive Operationen, RDMA und Verschlüsselung von der CPU und maximieren die Anwendungsleistung und Skalierbarkeit in anspruchsvollen Rechenzentrumsumgebungen.

DieDie in Absatz 1 genannten Anforderungen gelten nicht für die Berechnung der Leistungen.Diese Single-Port-QSFP56-Karte unterstützt bis zu200 Gbit/s(HDR InfiniBand oder 200GbE) mit voller Hardwarebeschleunigung für RDMA, zuverlässigen Transport und In-Network Computing.und NVMe über Fabrics BeschleunigungDie integrierte AES-XTS-Block-Level-Verschlüsselung gewährleistet die Datensicherheit ohne Leistungsschäden.Sie ist ideal für Finanzdienstleistungen., Regierungsforschung und Hyper-Cloud-Einsätze.

Bis zu 200 Gb/s (HDR InfiniBand / 200 GbE) auf einem einzelnen QSFP56

Bis zu 215 Millionen Nachrichten/Sekunde

XTS-AES 256/512-Bit auf Blockebene, FIPS-konform

Kollektive Entladungen, NVMe-oF-Ziel-/Initiatorentladungen, Burst-Puffer

PCIe Gen 4.0 / 3.0 x16 (zurückwärtskompatibel)

SR-IOV (1K VFs), ASAP2, offene vSwitch-Ablastung, Überlagerungstunnel

Unterstützung von RoCE, XRC, DCT, On-Demand Paging, GPUDirect RDMA

Stand-up-PCIe-Low-Profil, vorinstallierte hohe Halterung + kurze Halterung inklusive

NVIDIA ConnectX-6 integriertIn-Network-ComputingDie MCX653105A-HDAT unterstützt hardwarebasierten zuverlässigen Transport, adaptive Routing und Überlastungskontrolle,Gewährleistung einer vorhersehbaren Leistung bei großflächigen Stoffen.Ferner direkter Speicherzugriff (RDMA)ermöglicht eine Datenübertragung ohne Kopien, ohne den Betriebssystemkernel zu umgehen.NVIDIA GPUDirect RDMA, GPU-Speicher kommuniziert direkt mit dem Netzwerkadapter, Verkürzung der Latenzzeit für KI-Ausbildung und HPC-Simulationen.Verschlüsselung auf Blockebene XTS-AES(256/512-Bit-Schlüssel) gewährleistet die Sicherheit von Daten im Transit und Daten im Ruhezustand ohne CPU-Überlastung, und der Adapter ist so konzipiert, dass er den Anforderungen der FIPS 140-2 entspricht.

- Hochleistungsrechner (HPC):Größere Simulationen, Wettervorhersagen und fluidische Rechendynamik, die eine 200 Gb/s-Low-Latency-Verbindung erfordern.

- KI und Deep Learning-Cluster:Verteiltes Training mit GPUDirect RDMA maximiert den Durchsatz zwischen GPU-Knoten.

- NVMe-oF-Speichersysteme:Hochleistungsdiasaggregierter Speicher mit vollen Ziel-/Initiator-Auslastungen, wodurch die CPU-Auslastung reduziert wird.

- Hyperscale- und Cloud-Datenzentren:Virtualisierte Umgebungen mit SR-IOV, Überlagerungsnetzwerken und Hardware-beschleunigter Verschlüsselung.

- Finanzielle HandelsplattformenUltra-Low-Latency-deterministische Netzwerke für den algorithmischen Handel.

Der ConnectX-6 MCX653105A-HDAT interagiert nahtlos mit NVIDIA Quantum InfiniBand-Switches (HDR 200Gb/s), Standard 200GbE-Switches und einer Vielzahl von Serverplattformen.Es unterstützt die wichtigsten Betriebssysteme und Virtualisierungsstacks, die eine flexible Integration in die bestehende Infrastruktur gewährleistet.

| Parameter | Spezifikation |

|---|---|

| Produktmodell | Die in Absatz 1 genannten Anforderungen gelten nicht für die Berechnung der Leistungen. |

| Datenrate | 200 Gbit/s, 100 Gbit/s, 50 Gbit/s, 40 Gbit/s, 25 Gbit/s, 10 Gbit/s, 1 Gbit/s (InfiniBand und Ethernet) |

| Anschlüsse und Steckverbinder | 1x QSFP56 (unterstützt passive Kupfer-, aktive optische und AOC-Kabel) |

| Host-Schnittstelle | PCIe Gen 4.0 x16 (auch mit Gen 3 kompatibel).0, 2.0(unterstützt x8, x4, x2, x1 Konfigurationen) |

| Verzögerung | Submikrosekunden (typisch < 0,7 μs) |

| Nachrichtenrate | Bis zu 215 Millionen Nachrichten pro Sekunde |

| Verschlüsselung | XTS-AES 256/512-Bit-Hardware-Auslastung, FIPS 140-2 bereit |

| Formfaktor | PCIe-Low-Profile-Stand-up (vorinstalliert mit hoher Halterung, mit Zubehör für kurze Halterung) |

| Abmessungen (ohne Klammer) | 167.65mm x 68.90mm |

| Stromverbrauch | Typische 22 W 24 W (abhängig von der Nutzung der Verbindung) |

| Virtualisierung | SR-IOV (bis zu 1K virtuelle Funktionen), VMware NetQueue, NPAR, ASAP2-Flow-Offload |

| Management und Überwachung | NC-SI, MCTP über PCIe/SMBus, PLDM (DSP0248, DSP0267), I2C, SPI-Blitz |

| Fernsteuerung | InfiniBand, iSCSI, PXE, UEFI |

| Betriebssysteme | RHEL, SLES, Ubuntu, Windows Server, FreeBSD, VMware vSphere, OpenFabrics Enterprise Distribution (OFED), WinOF-2 |

| Nummer des Bestellteils (OPN) | Häfen | Höchstgeschwindigkeit | Host-Schnittstelle | Wesentliche Merkmale |

|---|---|---|---|---|

| Die in Absatz 1 genannten Anforderungen gelten nicht für die Berechnung der Leistungen. | 1x QSFP56 | 200 Gbit/s | PCIe 3.0/4.0 x16 | Single-Port, Hardware-Crypto, vollständige ConnectX-6-Auslastung, ideal für Server mit hoher Dichte |

| Die in Absatz 1 genannten Vorschriften gelten für die in Absatz 1 genannten Fahrzeuge. | 2x QSFP56 | 200 Gbit/s (Zwei-Anschluss) | PCIe 3.0/4.0 x16 | Dual-Port 200Gb/s mit Krypto, maximale Bandbreitendichte |

| Die in Absatz 1 genannten Anforderungen gelten nicht für die in Absatz 1 genannten Fahrzeuge. | 1x QSFP56 | 100 Gbit/s | PCIe 3.0/4.0 x16 | Single-Port 100Gb/s, kostengerecht optimiert für niedrigere Geschwindigkeitsanforderungen |

| Die in Absatz 1 genannten Anforderungen gelten nicht für die in Absatz 1 genannten Fahrzeuge. | 2x QSFP56 | 100 Gbit/s (Zwei-Anschluss) | PCIe 3.0/4.0 x16 | Dual-Port 100Gb/s, Virtualisierung und Speicherauslastung |

| MCX653436A-HDAT (OCP 3.0) | 2x QSFP56 | 200 Gbit/s | PCIe 3.0/4.0 x16 | OCP 3.0 Small Form Factor mit zwei Anschlüssen 200 Gb/s |

- Vollständige Bandbreite von 200 Gb/s:Ein Single-Port-Design liefert maximale Durchsatzleistung für Rechenknoten, bei denen hohe Dichte pro Port bevorzugt wird.

- Hardwaresicherheit eingebaut:XTS-AES-Blockverschlüsselung ohne CPU-Überlastung, die FIPS-Konformität für regulierte Branchen erfüllt.

- Beschleunigte Speicherung und KI:NVMe-oF-Offloads und GPUDirect RDMA steigern die Leistung für KI-Ausbildung und softwaredefinierten Speicher erheblich.

- Zukunftsfähige PCIe 4.0:Doppelte Bandbreite für den Host, wodurch Engpässe für 200 Gb/s Netzwerke beseitigt werden.

- Vereinfachte Verwaltung:Ein einheitlicher Treiberstack (OFED, WinOF-2) und eine breite Betriebssystemkompatibilität reduzieren die Komplexität der Bereitstellung.

Die Hong Kong Starsurge Group bietet fachkundigen technischen Support, Garantie-Abdeckung und globale RMA-Dienstleistungen für alle NVIDIA ConnectX-Adapter.LeistungsstimmungWir bieten flexible Preise, Massenangebote für Rechenzentrumsprojekte und schnellen weltweiten Versand.Kontaktieren Sie unser Verkaufsteam, um Lieferzeiten und Volumenrabatte zu besprechen.

• Überprüfen Sie, ob der PCIe-Slot ausreichend Leistung liefert (75 W aus dem Slot; der Adapter verbraucht typischerweise ~ 22-24 W).

• Für flüssiggekühlte Plattformen ist diese Standard-Luftgekühlte Karte nicht kompatibel mit Kaltplattenvarianten; wenden Sie sich an Starsurge, wenn Sie flüssiggekühlte SKU benötigen.

• Verwenden Sie immer QSFP56-kabel oder -module, um eine Leistung von 200 Gb/s zu erreichen.

• Bestätigen Sie die Kompatibilität der Treiberversion mit Ihrem Betriebssystem und Kernel vor der Bereitstellung.

Seit 2008 ist die Hong Kong Starsurge Group Co., Limited ein zuverlässiger Anbieter von Hardware für Unternehmensnetzwerke, Systemintegration und IT-Dienstleistungen.Als autorisierter Partner für NVIDIA-Netzwerklösungen, Starsurge liefert echte ConnectX-Adapter, Schalter und Kabel an Regierungs-, Finanz-, Gesundheits-, Bildungs- und Hyperskalakunden weltweit.Unsere erfahrenen Vertriebs- und technischen Teams sorgen für eine nahtlose Bereitstellung von der Vor- und Verkaufsarchitektur bis hin zum Support nach dem Verkauf, mit einem Engagement für zuverlässige Qualität und reaktionsschnelle Dienstleistungen.

Weltweite Lieferung · Mehrsprachiger Support · OEM- und Integrationsdienstleistungen auf Maß

| Komponente / Ökosystem | Unterstützung Status | Anmerkungen |

|---|---|---|

| NVIDIA Quantum HDR InfiniBand-Schalter | ✓ Vollständige Unterstützung | 200 Gb/s Stoff, adaptive Routing |

| 200GbE-Switches (IEEE 802.3) | ✓ Kompatibel | Erfordert FEC-Modi pro Schalterspezifikation |

| GPU Direct RDMA | ✓ Ja | NVIDIA-GPU-Serie (Volta, Ampere, Hopper usw.) |

| VMware vSphere 7.0/8.0 | ✓ Zertifiziert | Einheimische Fahrer, Unterstützung von SR-IOV |

| Linux (RHEL, Ubuntu, SLES) | ✓ volle Unterstützung | MLNX_OFED, verfügbare Inbox-Treiber |

| Windows Server 2019/2022 | ✓ Unterstützt | WinOF-2-Treiberpaket |

- [ ] Bestätigen Sie die erforderliche Verbindungsgeschwindigkeit: 200Gb/s Single-Port entspricht Ihren Bandbreitenanforderungen.

- [ ] Überprüfen Sie den PCIe-Slot des Servers: x16 physischer Slot, Gen 4 empfohlen für volle 200Gb/s Leistung.

- [ ] Wählen Sie geeignete QSFP56-Kabel oder Transceiver aus (passives Kupfer bis 5 m, AOC oder Optik).

- [ ] Überprüfen Sie die Betriebssystemtreiberunterstützung (OFED-Version oder Posteingang).

- [ ] Sicherstellen der Einhaltung der Anforderungen an die Verschlüsselung (XTS-AES, FIPS).

- [ ] Bewertung der Umgebungskühlung: Hochgeschwindigkeitsadapter erfordern möglicherweise einen gerichteten Luftstrom.