NVIDIA ConnectX-7 VPI Adapter – Dual-Port NDR 400Gb/s, PCIe 5.0, GPUDirect, RoCE – MCX75310AAS-NEAT

Produktdetails:

| Markenname: | Mellanox |

| Modellnummer: | MCX75310AAS-NEAT (900-9x766-003n-SQ0) |

| Dokumentieren: | Connectx-7 infiniband.pdf |

Zahlung und Versand AGB:

| Min Bestellmenge: | 1Stk |

|---|---|

| Preis: | Negotiate |

| Verpackung Informationen: | Äußere Box |

| Lieferzeit: | Auf der Grundlage der Bestände |

| Zahlungsbedingungen: | T/T |

| Versorgungsmaterial-Fähigkeit: | Versorgung nach Projekt/Batch |

|

Detailinformationen |

|||

| Modell Nr.: | MCX75310AAS-NEAT (900-9x766-003n-SQ0) | Häfen: | Single-Port |

|---|---|---|---|

| Technologie: | Infiniband | Schnittstellentyp: | OSFP56 |

| Spezifikation: | 16,7 cm x 6,9 cm | Herkunft: | Indien / Israel / China |

| Übertragungsrate: | 400gbe | Host -Schnittstelle: | Gen3 x16 |

| Hervorheben: | NVIDIA ConnectX-7 Netzwerkadapter,Dual-Port NDR 400Gb/s PCIe-Karte,Mellanox RoCE GPUDirect Adapter |

||

Produkt-Beschreibung

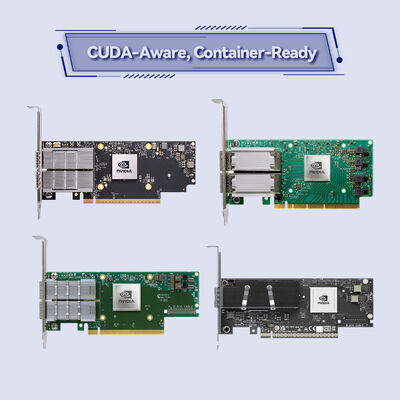

MCX755106AS‑HEAT | Dual-Port PCIe 5.0 Smart NIC

Beschleunigen Sie KI-, wissenschaftliche Computer- und Enterprise-Cloud-Workloads mit der NVIDIA ConnectX-7-Familie. Der MCX755106AS-HEAT liefert bis zu 200 Gbit/s InfiniBand (HDR) und 200 GbE Ethernet-Flexibilität, In-Network-Computing-Engines, Hardware-Sicherheit und extrem niedrige Latenzzeiten — alles über PCIe 5.0.

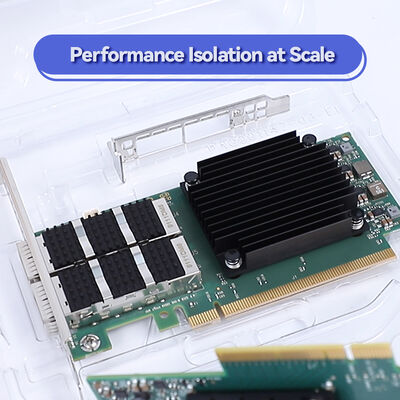

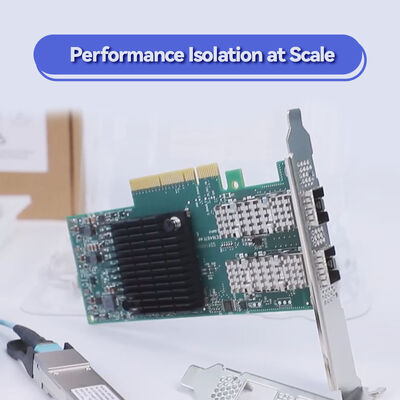

Der NVIDIA ConnectX-7 VPI-Adapter MCX755106AS-HEAT ist eine Dual-Port 200-Gbit/s-Smart-Netzwerkkarte, die für High-Performance-Computing (HPC)-Cluster, KI-Fabriken und Enterprise-Rechenzentren entwickelt wurde. Durch die Kombination von InfiniBand- und Ethernet-Protokollunterstützung ermöglicht er Remote Direct Memory Access (RDMA), GPUDirect Storage und fortschrittliche In-Network-Computing-Engines wie SHARPv3 und Rendezvous-Offload. Mit der PCIe 5.0-Host-Schnittstelle und hardwarebasierten Sicherheitsbeschleunigern entlastet dieser Adapter die CPU, reduziert die Gesamtbetriebskosten und liefert eine konsistente Leistung mit geringer Latenz.

Ideal für Organisationen, die ihre IT-Infrastruktur vom Edge bis zum Core modernisieren, bietet die ConnectX-7-Familie softwaredefinierte, hardwarebeschleunigte Netzwerk-, Speicher- und Sicherheitsfunktionen — für skalierbare und sichere Lösungen mit minimalem Overhead.

ConnectX-7 integriert die NVIDIA ASAP² (Accelerated Switch and Packet Processing)-Technologie, um softwaredefiniertes Networking mit Leitungsgeschwindigkeit zu liefern, ohne CPU-Kerne zu verbrauchen. Inline-Hardware-Engines verarbeiten die Verschlüsselung/Entschlüsselung für IPsec, TLS und MACsec und schützen Daten während der Übertragung vom Edge bis zum Core. Für Speicher ermöglichen integrierte NVMe-oF-Offloads und GPUDirect Storage den direkten Datentransfer zwischen Speicher und GPU-Speicher, wodurch Latenzzeiten reduziert und der Durchsatz maximiert wird. Der Adapter unterstützt auch erweiterte Zeitsynchronisation (PTP mit 12 ns Genauigkeit) und On-Demand-Paging (ODP) für registrierungsfreie RDMA, was ihn ideal für disaggregierte und speicherzentrierte Architekturen macht.

- KI- & Large Language Model (LLM)-Cluster: Hochgeschwindigkeits-Interconnect für GPU-Server, Nutzung von GPUDirect RDMA und SHARP Collective Offloads.

- High-Performance Computing (HPC): 200-Gbit/s-HDR-InfiniBand-Fabric für MPI, OpenSHMEM und wissenschaftliche Simulationen.

- Hyperscale Cloud & SDN-Rechenzentren: RoCEv2, Overlay-Beschleunigung und SR-IOV für Multi-Tenant-Virtualisierung.

- Enterprise Security Gateway: Inline-MACsec/IPsec-Verschlüsselung für Edge-to-Core-Kommunikation mit Hardware-Offload.

- Speichersysteme: NVMe-oF/TCP-Offload, verteilte Speicherplattformen, die extrem niedrige Latenzzeiten und hohe IOPS erfordern.

✅ Betriebssysteme: In-Box-Treiber für Linux (RHEL, Ubuntu), Windows Server, VMware ESXi (SR-IOV), Kubernetes (CNI-Plugins).

✅ Protokolle: InfiniBand (HDR/EDR), Ethernet (200 GbE bis 10 GbE), RoCE, RoCEv2, iSCSI, NVMe-oF, SRP, iSER, NFS über RDMA, SMB Direct.

✅ HPC-Middleware: NVIDIA HPC-X, UCX, UCC, NCCL, OpenMPI, MVAPICH, MPICH, OpenSHMEM.

✅ Verwaltung: NC-SI, MCTP über PCIe/SMBus, PLDM, Redfish, SPDM, sicheres Firmware-Update.

| Spezifikation | Details |

|---|---|

| Produktmodell | MCX755106AS-HEAT (NVIDIA ConnectX-7 VPI) |

| Maximale Geschwindigkeit | InfiniBand HDR 200 Gbit/s; Ethernet bis zu 200 GbE |

| Portkonfiguration | Dual-Port (unterstützt 1/2-Port-Varianten, dieses Modell Dual-Port QSFP56) |

| Host-Schnittstelle | PCIe 5.0 x16 (bis zu x32 Lanes mit Bifurkation / Multi-Host) |

| Formfaktor | PCIe HHHL (Half Height Half Length) – Standard-Bracket |

| Protokollunterstützung | InfiniBand (HDR/EDR) & Ethernet (200 GbE/100 GbE/50 GbE/25 GbE/10 GbE) |

| RDMA | RoCE, RoCEv2, Hardware-zuverlässiger Transport, DCT, XRC, On-Demand-Paging (ODP) |

| Sicherheits-Offload | Inline IPsec/TLS/MACsec (AES-GCM 128/256-Bit), Secure Boot, Flash-Verschlüsselung, Geräte-Attestierung |

| Speicher-Offload | NVMe-oF (TCP/Fabrics), NVMe/TCP, T10-DIF, Block-Level XTS-AES 256/512-Bit |

| Timing & Sync | IEEE 1588v2 (PTP), 12 ns Genauigkeit, SyncE (G.8262.1), konfigurierbares PPS, zeitgesteuerte Planung |

| Virtualisierung | SR-IOV, VirtIO-Beschleunigung, Overlay-Offload (VXLAN, GENEVE, NVGRE) |

| Erweiterte Funktionen | GPUDirect RDMA, GPUDirect Storage, SHARP-Offload, Adaptive Routing, Burst Buffer Offload |

| Verwaltung & Boot | UEFI, PXE, iSCSI-Boot, InfiniBand-Remote-Boot, PLDM, Redfish, SPDM, MCTP |

*Spezifikationen basieren auf NVIDIA-öffentlicher Dokumentation. Überprüfen Sie die genaue Konfiguration für Ihr System vor der Bestellung.

| Modell | Ports / Geschwindigkeit | Host-Schnittstelle | Zielgruppe |

|---|---|---|---|

| MCX755106AS-HEAT | 2-Port HDR 200 Gbit/s InfiniBand / 200 GbE | PCIe 5.0 x16 | KI-Cluster, HPC, Enterprise-Rechenzentren |

| MCX75310AAS-NEAT | 2-Port NDR 400 Gbit/s InfiniBand | PCIe 5.0 x16 | High-End-KI, groß angelegte HPC |

| OCP 3.0 Varianten | SFF / TSF mit HDR/NDR | PCIe Gen5 | Open Compute Project Server |

- Extrem niedrige Latenz & hoher Durchsatz: Hardware-RDMA und In-Network-Computing minimieren die Tail-Latenz von Anwendungen.

- Vereinheitlichte Fabric: Ein Adapter unterstützt sowohl InfiniBand als auch Ethernet, was Lagerbestand und Bereitstellung vereinfacht.

- Zukunftssicheres PCIe 5.0: 32 GT/s pro Lane, doppelte Bandbreite von PCIe 4.0, Beseitigung von I/O-Engpässen.

- Reduzierte Gesamtbetriebskosten: Entlastet die CPU von Netzwerk-, Speicher- und Sicherheitsaufgaben, was eine effizientere Serverauslastung ermöglicht.

- KI-optimiert: Native GPUDirect und SHARPv3 Collective Operations beschleunigen das Modelltraining und die Inferenz.

Hong Kong Starsurge Group Co., Limited bietet End-to-End-Support, einschließlich Pre-Sales-Beratung, kundenspezifischer Firmware-Konfiguration und weltweiten Versand. Alle ConnectX-7-Adapter werden mit einer 1-Jahres-Garantie (verlängerbar) und technischer Unterstützung durch erfahrene Netzwerk-Ingenieure geliefert. Wir bieten mehrsprachigen Support, RMA-Services und schnelle Ersatzlogistik, um Ausfallzeiten zu minimieren.

- Stellen Sie sicher, dass der PCIe-Steckplatz ausreichend Strom liefert (75 W über den Steckplatz, kein Hilfsstrom für den Normalbetrieb erforderlich).

- Prüfen Sie den physischen Platz: Der HHHL-Formfaktor passt in die meisten 1U/2U-Server; OCP-Varianten erfordern einen entsprechenden Mezzanine-Steckplatz.

- Für RoCE-Bereitstellungen konfigurieren Sie DCB (Priority Flow Control) und ECN auf den Switches für verlustfreies Ethernet.

- Aktualisieren Sie die Firmware immer auf die neueste stabile Version, um Sicherheits- und Leistungsverbesserungen zu nutzen.

Die 2008 gegründete Hong Kong Starsurge Group Co., Limited ist ein technologieorientierter Anbieter von Netzwerkhardware, IT-Dienstleistungen und Systemintegrationslösungen. Wir bedienen Kunden weltweit mit Produkten wie Netzwerk-Switches, NICs, drahtlosen Zugangspunkten, Controllern, Kabeln und Netzwerkausrüstung. Unser erfahrenes Vertriebs- und Technikteam unterstützt Branchen wie Regierung, Gesundheitswesen, Fertigung, Bildung, Finanzen und Unternehmen. Mit einem kundenorientierten Ansatz konzentriert sich Starsurge auf zuverlässige Qualität, reaktionsschnellen Service und maßgeschneiderte Lösungen — und hilft Kunden beim Aufbau einer effizienten, skalierbaren und zuverlässigen Netzwerkinfrastruktur.

Wir bieten IoT-Lösungen, Netzwerkmanagement-Systeme, kundenspezifische Softwareentwicklung, mehrsprachigen Support und globale Lieferung. Wählen Sie Starsurge als Ihren vertrauenswürdigen Partner für NVIDIA-Netzwerklösungen.