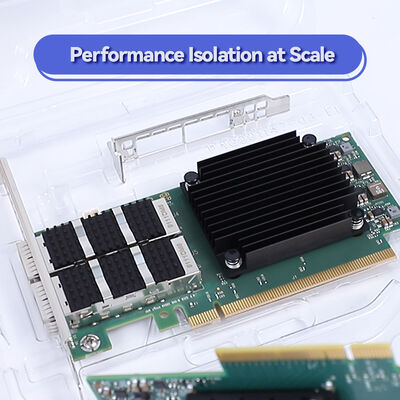

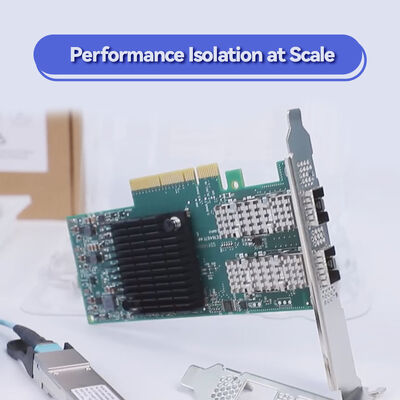

NVIDIA ConnectX-7 NDR 400Gb/s InfiniBand Adapter MCX75310AAS-HEAT

Produktdetails:

| Markenname: | Mellanox |

| Modellnummer: | MCX75310AAS-Heat (900-9x766-003n-st0) |

| Dokumentieren: | Connectx-7 infiniband.pdf |

Zahlung und Versand AGB:

| Min Bestellmenge: | 1Stk |

|---|---|

| Preis: | Negotiate |

| Verpackung Informationen: | Äußere Box |

| Lieferzeit: | Auf der Grundlage der Bestände |

| Zahlungsbedingungen: | T/T |

| Versorgungsmaterial-Fähigkeit: | Versorgung nach Projekt/Batch |

|

Detailinformationen |

|||

| Modell Nr.: | MCX75310AAS-Heat (900-9x766-003n-st0) | Häfen: | Single-Port |

|---|---|---|---|

| Technologie: | Infiniband | Schnittstellentyp: | OSFP56 |

| Spezifikation: | 16,7 cm x 6,9 cm | Herkunft: | Indien / Israel / China |

| Übertragungsrate: | 200gbe | Host -Schnittstelle: | Gen3 x16 |

Produkt-Beschreibung

RDMA-Netzwerke mit extrem niedriger Latenz für KI-Fabriken, HPC-Cluster und Hyperscale-Cloud. Unterstützt InfiniBand NDR (400Gb/s) und Ethernet bis zu 400GbE. In-Network Computing-Engines, Hardware-Sicherheitsbeschleunigung und GPUDirect® Storage-fähig.

Die NVIDIA ConnectX-7-Familie definiert die Rechenzentrumskonnektivität neu mit bis zu 400Gb/s Bandbreite, hardwarebasierter zuverlässiger Übertragung und fortschrittlichem In-Network Computing. Das Modell MCX75310AAS-HEAT gehört zur ConnectX-7 VPI-Adapterserie, die sowohl InfiniBand (NDR/HDR/EDR) als auch Ethernet (400GbE bis 10GbE) unterstützt. Entwickelt für KI, wissenschaftliches Rechnen und moderne softwaredefinierte Speicher, bietet er eine Latenz von unter einer Mikrosekunde und entlastet CPU-Kerne durch Beschleunigungs-Engines für Sicherheit, Virtualisierung und NVMe-oF. Mit der PCIe Gen5-Host-Schnittstelle maximiert dieser Adapter den Datendurchsatz für GPU-Cluster und Hochfrequenzhandelsumgebungen.

Durch die Nutzung von ASAP² (Accelerated Switch and Packet Processing) und Zero-Touch RoCE vereinfacht der Adapter die Bereitstellung und bietet Inline-Hardwareverschlüsselung – vom Edge bis zum Core. Unternehmen können ihre Infrastruktur mit NDR-Geschwindigkeiten und flexibler Multi-Host-Unterstützung zukunftssicher machen.

Dual-Port NDR 400Gb/s InfiniBand oder 400GbE, PCIe Gen5 x16 (bis zu 32 Lanes).

SHARPv3 Collective Operations Offload, Rendezvous-Protokoll-Offload, On-Board-Speicher für Bursts.

Inline IPsec/TLS/MACsec AES-GCM 128/256-Bit, Secure Boot mit Hardware Root-of-Trust, Flash-Verschlüsselung.

IEEE 1588v2 PTP (12ns Genauigkeit), SyncE, Klasse C G.8273.2, zeitgesteuerte Taktung.

GPUDirect RDMA, GPUDirect Storage, NVMe-oF Offload, T10-DIF Signaturübergabe.

VXLAN, GENEVE, NVGRE, programmierbarer flexibler Parser, Verbindungsverfolgung (L4-Firewall).

NVIDIA ASAP² (Accelerated Switch and Packet Processing) entlastet gesamte Datenpfade und liefert SDN-Leistung mit Leitungsgeschwindigkeit und null CPU-Overhead. ConnectX-7 integriert fortschrittliche Speicher-Virtualisierung: On-Demand Paging (ODP), User Mode Registration (UMR) und Adressübersetzungsdienste (ATS) für effiziente containerisierte Workloads. Mit Unterstützung für SR-IOV, VirtIO-Beschleunigung und Multi-Host-Technologie (bis zu 4 Hosts) ermöglicht der Adapter Bare-Metal-Leistung in virtualisierten Umgebungen. Die RoCE-Hardware-Engine sorgt für eine Zero-Touch-Bereitstellung für konvergierte Ethernet-Fabriken, während der In-Network-Speicher die Latenz für MPI- und Collective-Communication-Bibliotheken (NVIDIA HPC-X, UCX, NCCL) reduziert.

Um die Sicherheit vom Edge bis zum Core zu gewährleisten, verarbeiten Inline-Kryptografie-Engines IPsec, TLS 1.3 und MACsec, ohne Ausführungskerne zu verbrauchen, was sie ideal für Multi-Tenant-Clouds und Finanzdienstleistungen macht.

- KI- und Large Language Model-Cluster: RDMA & GPUDirect beschleunigen verteiltes Training über Hunderte von GPUs.

- High-Performance Computing (HPC): MPI-Offloads, SHARPv3 für In-Network-Reduktion, adaptive Routing.

- Cloud- und Edge-Rechenzentren: Overlay-Netzwerkbeschleunigung, VXLAN-Offload, SR-IOV.

- Softwaredefinierte Speicher (SDS): NVMe/TCP, NVMe-oF, iSER, NFS über RDMA.

- Echtzeit-Analysen & Handel: Extrem niedrige Latenz + PTP-Klasse-C-Synchronisation.

| Komponente / Ökosystem | Unterstützte Optionen |

|---|---|

| Host-Schnittstelle | PCIe Gen5 (bis zu x32 Lanes, typisch x16), PCIe-Bifurkation, Multi-Host (4 Hosts) |

| Betriebssysteme | Linux (RHEL, Ubuntu, In-Box-Treiber), Windows Server, VMware ESXi (SR-IOV), Kubernetes |

| Virtualisierung & Container | SR-IOV, VirtIO-Beschleunigung, NVMe over TCP Offload für Container |

| HPC-Middleware / Bibliotheken | OpenMPI, MVAPICH, MPICH, UCX, NCCL, UCC, OpenSHMEM, PGAS |

| Speicherprotokolle | NVMe-oF (RDMA/TCP), SRP, iSER, NFS über RDMA, SMB Direct, GPUDirect Storage |

| Parameter | Spezifikation |

|---|---|

| Produktmodell | MCX75310AAS-HEAT |

| Formfaktoren | PCIe HHHL / FHHL, OCP 3.0 SFF/TSFF (siehe Bestellhandbuch) |

| InfiniBand-Geschwindigkeiten | NDR 400Gb/s, HDR 200Gb/s, EDR 100Gb/s |

| Ethernet-Geschwindigkeiten | 400GbE, 200GbE, 100GbE, 50GbE, 25GbE, 10GbE (NRZ/PAM4) |

| Netzwerkports | 1/2/4-Port-Konfigurationen (abhängig von SKU; 2-Port typisch für dieses Modell) |

| Host-Bus | PCI Express Gen 5.0 (kompatibel mit Gen4/Gen3), bis zu x32 Lanes, TLP-Verarbeitungshinweise, ATS, PASID |

| Sicherheits-Offloads | Inline IPsec (AES-GCM 128/256), TLS 1.3, MACsec, Secure Boot, Flash-Verschlüsselung, Geräte-Attestierung |

| RDMA / Transport | Hardware-zuverlässiger Transport, XRC, DCT, On-Demand Paging, UMR, GPUDirect RDMA |

| Timing & Sync | IEEE 1588v2 PTP, G.8273.2 Klasse C, 12 ns Genauigkeit, SyncE, PPS In/Out, zeitgesteuerte Planung |

| Management | NC-SI, MCTP über PCIe/SMBus, PLDM (DSP0248/0267/0218), SPDM, SPI-Flash, JTAG |

| Remote Boot | InfiniBand Remote Boot, iSCSI, UEFI, PXE |

| Open Networking | ASAP² für SDN, VXLAN/GENEVE/NVGRE Offload, Flow Mirroring, hierarchisches QoS, L4-Verbindungsverfolgung |

| Stromversorgung & Umwelt | Siehe Benutzerhandbuch (typisch ca. 15W-25W je nach Konfiguration), Betriebstemperatur: 0°C bis 55°C (nicht öffentlich spezifiziert, pro SKU prüfen) |

| Beispiel für Teilenummer | Ports / Geschwindigkeit | Formfaktor | Typische Verwendung |

|---|---|---|---|

| MCX75310AAS-HEAT | NDR 400Gb/s Dual-Port, PCIe 5.0 x16 | PCIe HHHL / FHHL | Top-of-Rack KI & HPC, GPU-Cluster |

| MCX75340AAS-HEAT (Beispiel) | 4-Port NDR200 / 200GbE | OCP 3.0 | Hyperscale & Multi-Host |

| Andere ConnectX-7 SKUs | Single/Dual-Port, 100G/200G/400G | OCP, FHHL | Enterprise, Speicherappliances |

Für Unterstützung bei der Auswahl der richtigen SKU (Kabelunterstützung, Halterungstyp, hohe/niedrige Halterung) kontaktieren Sie das Starsurge-Team.

- ✅ Original & zertifizierte Teile – volle Garantie, sichere Lieferkette.

- ✅ Beratung zur Architektur vor dem Verkauf – HPC / KI-Cluster-Design, RDMA-Tuning.

- ✅ Globale Logistik & schnelle Erfüllung – Lagerbestände in Asien/Europa/Amerika.

- ✅ Benutzerdefinierte Firmware & OEM-Optionen – Konfiguration für Großaufträge anfordern.

- ✅ Technischer Support nach dem Verkauf – Treiberintegration, Firmware-Updates, RMA.

Hong Kong Starsurge Group bietet umfassenden Lifecycle-Support: von der Kompatibilitätsprüfung bis zur Bereitstellung und laufenden Wartung. Unsere Ingenieure unterstützen bei:

- InfiniBand-Fabric-Design und Leistungsoptimierung.

- RoCE-Konfiguration für Ethernet-Umgebungen.

- Integration mit GPUDirect Storage und NVMe-oF-Zielen.

- 3 Jahre Standardgarantie plus erweiterte Abdeckung verfügbar.

Volumenpreise, Großversand und Anpassungen (Halterungen, Zuglaschen) sind auf Anfrage erhältlich.

NDR beinhaltet fortschrittliche In-Network-Computing-Funktionen wie SHARP, adaptive Routing und hardwarebasierte zuverlässige Übertragung nativ; der Ethernet-Modus verwendet RoCE für RDMA mit der gleichen Leitungsgeschwindigkeit. ConnectX-7 unterstützt beides über Dual Personality.

Ja, der Adapter ist abwärtskompatibel mit PCIe Gen4 und Gen3, jedoch mit reduzierter Lane-Geschwindigkeit. Die beste Leistung wird auf PCIe Gen5-Slots erzielt.

Ja, ConnectX-7 unterstützt die NVIDIA Multi-Host-Technologie, die es bis zu 4 unabhängigen Hosts ermöglicht, denselben Adapter zu teilen (abhängig von der spezifischen SKU und Verkabelung). Bitte im Bestellhandbuch bestätigen.

IPsec (AES-GCM 128/256-Bit), TLS (AES-GCM 128/256-Bit) und MACsec (AES-GCM 128/256-Bit). Alle werden von der CPU entlastet.

Absolut. ConnectX-7 entlastet NVMe over TCP sowie NVMe-oF und reduziert den Host-CPU-Overhead für Speicher.

- Sorgen Sie für ausreichende Luftzirkulation im Servergehäuse bei Verwendung von Hochleistungs-Transceivern (aktive optische Kabel oder DAC).

- Verwenden Sie Firmware von NVIDIA oder von Starsurge validierte Firmware für Sicherheitspatches.

- Installieren Sie den neuesten Treiber (MLNX_OFED oder native In-Box-Treiber), um die vollständige Hardware-Entlastung zu aktivieren.

- Überprüfen Sie die QSFP-DD- oder OSFP-Kompatibilität für 400G-Optiken; siehe NVIDIA Ethernet Transceiver Guide.

- ESD-Schutz erforderlich – der Adapter enthält empfindliche PCIe-Komponenten.

Hong Kong Starsurge Group Co., Limited ist ein technologieorientierter Anbieter von Netzwerkhardware, IT-Dienstleistungen und Systemintegrationslösungen. Gegründet im Jahr 2008, bedient das Unternehmen Kunden weltweit mit Produkten wie Netzwerk-Switches, NICs, drahtlosen Zugangspunkten, Controllern, Kabeln und zugehöriger Ausrüstung. Unterstützt von einem erfahrenen Vertriebs- und Technikteam, bedient Starsurge Branchen wie Regierung, Gesundheitswesen, Fertigung, Bildung, Finanzen und Unternehmen. Das Unternehmen bietet auch IoT-Lösungen, Netzwerkmanagement-Systeme, kundenspezifische Softwareentwicklung, mehrsprachigen Support und globale Lieferung. Mit einem kundenorientierten Ansatz konzentriert sich Starsurge auf zuverlässige Qualität, reaktionsschnellen Service und maßgeschneiderte Lösungen, die Kunden beim Aufbau effizienter, skalierbarer und zuverlässiger Netzwerkinfrastrukturen unterstützen.

✓ Autorisierter Partner führender Marken, einschließlich NVIDIA-Netzwerkprodukten.

| Maximaler Durchsatz | 400 Gb/s (NDR / 400GbE) | PCIe Gen5 | Bis zu 32 Lanes |

|---|---|---|---|

| RDMA-Unterstützung | InfiniBand & RoCE | Sicherheit | IPsec/TLS/MACsec Inline |

| GPUDirect | RDMA + Speicher | Timing-Genauigkeit | 12ns PTP |

| Komponente | Empfohlen / Unterstützt | Anmerkungen |

|---|---|---|

| GPU-Server (HGX/DGX) | Vollständig kompatibel mit GPUDirect | SHARP-Offload auf InfiniBand |

| Top-of-Rack-Switches | NVIDIA QM9700 (NDR), SN4000 (Ethernet) | Unterstützt |

| Virtualisierungshosts | VMware ESXi 7.0/8.0, KVM, Hyper-V | SR-IOV aktiviert |

| Speichersysteme | PureStorage, VAST Data, WEKA, Dell PowerScale | NVMe-oF / RoCE-fähig |

| Kabel / Optiken | NVIDIA passive Kupfer-DAC, aktive optische Kabel (400G SR4/DR4) | Kompatibilitätsmatrix bestätigen |

- Bestätigen Sie die Portkonfiguration (2-Port NDR oder geteilte 2x200G), die zu Ihrem Switch-Plan passt.

- Bestätigen Sie die physische Länge des PCIe-Steckplatzs und den Halterungstyp (HHHL / FHHL).

- Prüfen Sie die Luftstromrichtung und die Anforderungen an passive/aktive Kabel.

- Stellen Sie die OS-Treiberunterstützung sicher (MLNX_OFED-Version für Ihren Kernel).

- Für Sicherheitsfunktionen: Aktivieren Sie Secure Boot & Inline Crypto in der Firmware.

- Überprüfen Sie Garantie- und Advance-Replacement-Optionen.

64-Port 400G InfiniBand, SHARPv3-Integration.

Kostengünstige 200Gb/s für kleinere Cluster.

Speicher- & Sicherheitsbeschleunigung + programmierbarer Datenpfad.

Kompatible OSFP zu 2xOSFP oder 2xQSFP56.