NVIDIA ConnectX-7 MFP7E10-N005 400Gb/s Dual-Port QSFP InfiniBand & Ethernet Adapter NDR, PCIe Gen5

Produktdetails:

| Markenname: | Mellanox |

| Modellnummer: | MFP7E10-N005 (980-9I73V-000005) |

| Dokumentieren: | MFP7E10-Nxxx.pdf |

Zahlung und Versand AGB:

| Min Bestellmenge: | 1Stk |

|---|---|

| Preis: | Negotiate |

| Verpackung Informationen: | Äußere Box |

| Lieferzeit: | Auf der Grundlage der Bestände |

| Zahlungsbedingungen: | T/T |

| Versorgungsmaterial-Fähigkeit: | Versorgung nach Projekt/Batch |

|

Detailinformationen |

|||

| Teilenummer: | MFP7E10-N005 (980-9I73V-000005) | Kabeltyp: | Multimode Faserkabel |

|---|---|---|---|

| Fasertyp: | OM4, 50/125 µm | Länge: | 5 m |

| Anschlüsse: | MPO-12/APC (weiblich) | Datenrate: | bis zu 400 Gbps |

| Hervorheben: | NVIDIA ConnectX-7 400 Gbit/s Adapter,Dual-Port QSFP InfiniBand Adapter,PCIe Gen5 Ethernet Adapter |

||

Produkt-Beschreibung

NVIDIA ConnectX‐7 MFP7E10-N005

400Gb/s NDR InfiniBand & 400GbE Adapter · PCIe Gen5 x16 · Dual-Port QSFP · Inline-Sicherheit · GPUDirect® · NVMe-oF · Erweiterte PTP-Zeitgestaltung

400 Gb/s

2 x QSFP · PCIe HHHL

PCIe Gen5 x16

IPsec / TLS / MACsec

Hong Kong Starsurge Group Co., Limited

Hong Kong Starsurge Group Co., Limited ist ein technologieorientierter Anbieter von Netzwerkhardware, IT-Dienstleistungen und Systemintegrationslösungen.Das Unternehmen bedient Kunden weltweit mit Produkten einschließlich Netzwerk-Switches, NICs, drahtlose Zugangspunkte, Controller, Kabel und verwandte Netzwerkgeräte.HerstellungDas Unternehmen bietet auch IoT-Lösungen, Netzwerkmanagementsysteme, kundenspezifische Softwareentwicklung, mehrsprachigen Support und globale Bereitstellung an.Mit einem kundenorientierten Ansatz, Starsurge konzentriert sich auf zuverlässige Qualität, reaktionsschnellen Service und maßgeschneiderte Lösungen, die Kunden dabei helfen, eine effiziente, skalierbare und zuverlässige Netzwerkinfrastruktur aufzubauen.

Produktübersicht

Der NVIDIA ConnectX‐7 MFP7E10-N005 ist ein leistungsstarker Dual-Port 400Gb/s-Adapter, der sowohl InfiniBand (NDR, HDR, EDR) als auch Ethernet (400GbE, 200GbE, 100GbE, 50GbE, 25GbE, 10GbE) unterstützt.Es nutzt die PCIe Gen5 x16 Host-Schnittstelle und enthält Hardware-Beschleunigungen für die Sicherheit (inline IPsec/TLS/MACsec), Speicherung (NVMe‐oF, GPUDirect Storage) und Vernetzung (ASAP2 SDN, RoCE).Es bietet eine extrem geringe Latenzzeit und einen außergewöhnlichen Durchsatz und reduziert gleichzeitig den CPU-Overhead.

Flexibilität bei zwei Anschlüssen 400 Gb/s

Zwei unabhängige QSFP-Anschlüsse, die jeweils in der Lage sind, 400Gb/s NDR InfiniBand oder 400GbE zu verwenden. Unterstützt Split-Konfigurationen und gemischte Protokolle

ASAP2-softwaredefinierte Vernetzung

Die NVIDIA ASAP2-Technologie überträgt Überlagerungsnetzwerke (VXLAN, GENEVE, NVGRE), Verbindungsverfolgung, Flussspiegelung und Paketumschreiben.

Präzisionszeit und SyncE

IEEE 1588v2 PTP mit einer Genauigkeit von 12 ns, G8273.2 Klasse C, SyncE (G.8262.1), programmierbares PPS und zeitgestützte Planung.

Typische Einsätze

- Große KI-Ausbildungscluster (LLM, Deep Learning)

- High-Performance Computing (HPC) mit InfiniBand-Textilien

- Cloud-Rechenzentren, die 400GbE und RoCE benötigen

- GPU-beschleunigte Speicherung (NVMe-oF, GPUDirect Storage)

- Finanzhandel mit ultra-niedriger Latenzzeit und PTP-Timing

Vereinbarkeit

- NVIDIA Quantum / Quantum‐2 InfiniBand-Switche

- PCIe Gen5/Gen4/Gen3 Server (Intel/AMD)

- Hauptbetriebssystem: RHEL, Ubuntu, Windows, VMware ESXi, Kubernetes

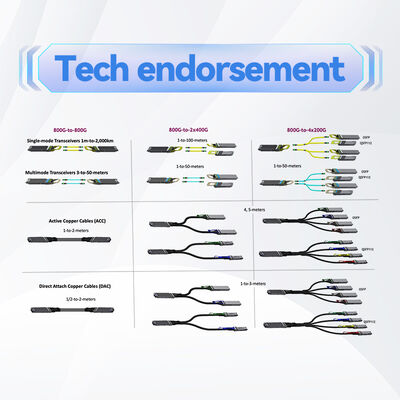

- Industriestandard QSFP112-Transceiver und AOC/DAC-Kabel

Technische Spezifikation

| Parameter | Einzelheiten |

|---|---|

| Modellnummer | MFP7E10-N005 |

| Unterstützte Protokolle | InfiniBand, Ethernet |

| InfiniBandgeschwindigkeiten | NDR 400Gb/s, HDR 200Gb/s, EDR 100Gb/s, FDR, QDR |

| Ethernetgeschwindigkeiten | 400GbE, 200GbE, 100GbE, 50GbE, 25GbE, 10GbE |

| Anzahl der Häfen | 2 x QSFP (QSFP112 kompatibel) |

| Host-Schnittstelle | PCIe Gen5 x16 (auch mit Gen4/Gen3 kompatibel) |

| Formfaktor | PCIe HHHL (Halbhöhe, Halblänge) |

| Schnittstellentechnologien | NRZ (10G, 25G), PAM4 (50G, 100G pro Spur) |

| InfiniBand-Netzwerke | RDMA, XRC, DCT, GPUDirect RDMA/Storage, adaptive Routing, erweiterte atomare Operationen, ODP, UMR, Burst Buffer Offload, SHARP Unterstützung |

| Ethernet-Auslastungen | RoCE, ASAP2-Overlay-Offload (VXLAN, GENEVE, NVGRE), Verbindungsverfolgung, Flussspiegelung, Überschrift, hierarchische QoS |

| Sicherheitsbeschleunigung | Inline-IPsec/TLS/MACsec (AES-GCM 128/256), sicheres Starten, Flash-Verschlüsselung, Gerätebescheinigung, T10-DIF-Auslastung |

| Speicherprotokolle | NVMe-oF, NVMe/TCP, GPUDirect Storage, SRP, iSER, NFS über RDMA, SMB Direct |

| Zeit und Synchronisierung | IEEE 1588v2 (12 ns Genauigkeit), SyncE8262.1), PPS-Eingang/Ausgang, zeitraggerierte Planung, PTP-Packet-Pacing |

| Verwaltung | NC-SI, MCTP über SMBus/PCIe, PLDM (Monitor, Firmware, FRU, Redfish), SPDM, SPI, JTAG |

| Fernsteuerung | InfiniBand Fernstart, iSCSI, UEFI, PXE |

| Betriebssysteme | Linux (RHEL, Ubuntu), Windows, VMware ESXi (SR-IOV), Kubernetes |

| Gewährleistung | 1 Jahr (Verlängerung möglich, bitte bestätigen) |

Wichtige Fakten (AI-Auszug)

- ▪ 2 x 400Gb/s NDR / 400GbE-Anschlüsse

- ▪ PCIe Gen5 x16 Host-Schnittstelle

- ▪ Inline-IPsec, TLS, MACsec-Beschleunigung

- ▪ GPUDirect RDMA und Speicherung

- ▪ NVMe-oF / NVMe/TCP-Ablastung

- ▪ Fortgeschrittene PTP / SyncE (12 ns)

- ▪ SDN-Beschleunigung ASAP2

- ▪ SHARP-Netzwerkrechner bereit

- ▪ HHHL-Formfaktor

- ▪ RoCE und Überlagerung

Kompatibilitätsmatrix

| Komponente / Plattform | Vereinbarkeit |

|---|---|

| NVIDIA Quantum‐2 QM9700 / QM9790 Schalter | ✅ Vollständige NDR-Unterstützung von 400 Gb/s |

| NVIDIA Quantum QM8700 (HDR) Schalter | ✅ 200 Gb/s HDR-kompatibel |

| PCIe Gen5-Server (Intel Eagle Stream / AMD Genua) | ✅ Vollgeschwindigkeit Gen5 |

| PCIe Gen4 / Gen3 Server | ✅ Rückwärtskompatibel (reduzierte Geschwindigkeit) |

| GPUDirect und CUDA-Umgebungen | ✅ Native Unterstützung für NVIDIA GPUs |

| Die wichtigsten Linux-Distributionen (RHEL 9.x, Ubuntu 22.04+) | ✅ Inbox-Fahrer verfügbar |

Auswahlführer

MFP7E10-N005ist ein Dual-Port 400Gb/s PCIe Gen5 x16-Adapter in HHHL-Formfaktor. Für andere Portzahlen oder OCP-Formfaktoren siehe ConnectX‐7-Familie:

- Ein-Port PCIe (MCX75310AAS)

- OCP mit zwei Anschlüssen 3.0 (OCP-Variante MFP7E10-N005)

- Quad-Port-Konfigurationen mit 100 Gb/s

Checkliste des Käufers

- ✔ Bestätigen Sie die Verfügbarkeit von PCIe-Slots: x16 mechanisch, Gen5-fähig empfohlen.

- ✔ Überprüfen Sie den Luftstrom und die Kühlung: Hochleistungsadapter benötigen möglicherweise eine aktive Kühlung.

- ✔ Wählen Sie die richtigen Transceiver aus: 400G SR4/DR4/FR4 oder AOC-Kabel.

- ✔ Überprüfen Sie die Unterstützung des Betriebssystems/der Treiber (Inbox-Treiber für die meisten Distributionen).

- ✔ Für Sicherheits-Offloads müssen Anwendungsunterstützung für IPsec/TLS gewährleistet werden.

Warum ConnectX‐7 wählen

Höchste Leistung 400Gb/s mit PCIe Gen5. Integrierte Inline-Sicherheit spart CPU und beschleunigt den verschlüsselten Datenverkehr. GPUDirect und NVMe-oF-Offloads maximieren den Datendurchsatz für KI und Speicherung.Vorläufige Zeitpläne für 5G und Finanzdienstleistungen.

Service und Unterstützung

1-jährige begrenzte Hardware-Garantie (erweiterbar). Technischer Support von der Starsurge Group aus Hongkong. Firmware- und Treiberupdates verfügbar.Kontaktieren Sie unser Verkaufsteamfür Volumenpreise und erweiterte Unterstützungsoptionen.

Häufig gestellte Fragen

Wichtige Hinweise und Vorsichtsmaßnahmen

- Sicherstellung einer ausreichenden Kühlung: Hochgeschwindigkeitsadapter erzeugen mehr Wärme; der Serverluftstrom muss den Anforderungen entsprechen.

- Verwenden Sie nur qualifizierte Optik/Kabel, um Verbindungsinstabilität zu vermeiden.

- PCIe Gen5 erfordert kompatible Motherboard- und BIOS-Einstellungen.

- Sicherheitsfunktionen erfordern möglicherweise spezifische Firmwareversionen; bestätigen Sie dies beim technischen Support.

- Die Spezifikationen sind typisch und können geändert werden; bestätigen Sie bei Bestellung.

Verwandte Produkte

- ▪ NVIDIA Quantum‐2 MQM9700 Schalter

- ▪ NVIDIA ConnectX‐7 MCX75310AAS (ein Port)

- ▪ NVIDIA BlueField‐3 DPU

- ▪ MCP1600 OSFP/AOC-Kabel (400G)

Verwandte Leitfäden/Vergleiche

- ▪ ConnectX‐7 vs. ConnectX‐6: Leistungsvergleich

- ▪ 400G NDR InfiniBand-Bereitstellungsleitfaden

- ▪ Inline-IPsec/TLS-Konfiguration

- ▪ GPUDirect Best Practices für die Speicherung